Generative Pre-trained Transformer 2 (GPT-2 ) は、2019年 nián 月 yuè OpenAI によって開 kaī 発 fā オープンソース の人 rén 工 gōng 知 zhī 能 néng [ 1] [ 2] [ 3] [ 4] 翻 fān 訳 yì 質 zhí 問 wèn 答 dá 文 wén 章 zhāng 要 yaò 約 yuē 行 xíng [ 5] 時 shí 人 rén 間 jiān 見 jiàn 分 fēn テキスト出 chū 力 lì 生 shēng 成 chéng するが[ 6] 長 cháng 文 wén 章 zhāng 生 shēng 成 chéng 繰 qiaō 返 făn 意 yì 味 weì 不 bù 明 míng 表 biaŏ 現 xiàn [ 7] 多 duō 目 mù 的 de 学 xué 習 xí 器 qì 特 tè 定 dìng 仕 shì 事 shì 行 xíng 特 tè 別 bié 訓 xùn 練 liàn 受 shoù 行 xíng 能 néng 力 lì 任 rèn 意 yì 順 shùn 序 xù 次 cì 項 xiàng 目 mù 正 zhèng 確 què 合 hé 成 chéng 一 yī 般 bān 的 de 能 néng 力 lì 延 yán 長 cháng 線 xiàn 上 shàng [ 8] [ 5] 年 nián 版 băn GPT モデルの「スケールアップ版 băn 構 goù 築 zhú [ 9] 数 shù 訓 xùn 練 liàn 用 yòng 倍 beì 増 zēng 加 jiā [ 4]

GPTアーキテクチャは、ディープラーニング(深 shēn 層 céng 学 xué 習 xí によるニューラルネットワーク 、具 jù 体 tĭ 的 de Transformer )モデル」を実 shí 装 zhuāng [ 9] 回 huí 帰 guī 型 xíng 畳 dié 型 xíng 代 daì アテンション 」を使 shĭ 用 yòng [ 10] [ 11] 機 jī 構 goù 入 rù 力 lì 中 zhōng 最 zuì 関 guān 連 lián 性 xìng 高 gaō 予 yŭ 測 cè 部 bù 位 weì 選 xuăn 択 zé 的 de 焦 jiaō 点 diăn 当 dāng [ 12] [ 13] 並 bìng 列 liè 化 huà 大 dà 幅 fú 向 xiàng 上 shàng 基 jī ベンチマーク よりも優 yoū 性 xìng 能 néng 発 fā 揮 huī [ 9]

OpenAIは、2019年 nián 月 yuè 言 yán 語 yŭ 完 wán 全 quán 版 băn 億 yì 個 gè 含 hán 公 gōng 開 kaī [ 14] 続 xù 億 yì 個 gè 含 hán GPT-3 [ 15] 年 nián 公 gōng 開 kaī 予 yŭ 定 dìng [ 16] 公 gōng 開 kaī マイクロソフト が提 tí 供 gōng アプリケーションプログラミングインタフェース (API)を通 tōng 提 tí 供 gōng [ 17]

コンピュータの黎 lí 明 míng 期 qī (英 yīng 語 yŭ 版 băn 人 rén 工 gōng 知 zhī 能 néng 研 yán 究 jiū 対 duì 象 xiàng 年 nián アラン・チューリング が提 tí 唱 chàng イミテーション・ゲーム (imitation game)」(しばしばチューリング・テストと呼 hū 電 diàn 子 zĭ 機 jī 械 xiè 的 de 知 zhī 的 de 行 xíng 動 dòng 能 néng 力 lì 評 píng 価 jià 者 zhě 人 rén 間 jiān 行 xíng 動 dòng 区 qū 別 bié 能 néng 力 lì 判 pàn 定 dìng 提 tí 案 àn [ 18] 機 jī 械 xiè 学 xué 習 xí 用 yòng 語 yŭ 早 zaŏ 年 nián IBM の研 yán 究 jiū 者 zhě アーサー・サミュエル によって、人 rén 工 gōng 知 zhī 能 néng 可 kě 能 néng 性 xìng 説 shuō 明 míng 言 yán 葉 xié 最 zuì 初 chū 使 shĭ [ 19] 現 xiàn 在 zaì 用 yòng 語 yŭ 統 tŏng 計 jì 的 de 学 xué 習 xí データサイエンス 、ニューラルネットワーク など、計 jì 算 suàn 問 wèn 題 tí 対 duì 手 shoŭ 法 fă 人 rén 工 gōng 知 zhī 能 néng 下 xià 置 zhì 包 baō 含 hán

コンピュータによる自 zì 然 rán 言 yán 語 yŭ 処 chŭ 理 lĭ 計 jì 算 suàn 言 yán 語 yŭ 学 xué 一 yī 分 fēn 野 yě 考 kaŏ 能 néng 力 lì 備 beì 同 tóng 時 shí 試 shì 年 nián バークベック・カレッジ で開 kaī 発 fā 辞 cí 書 shū ルックアップテーブル が最 zuì 初 chū 応 yīng 用 yòng 例 lì [ 20] 年 nián ジョージタウン大 dà 学 xué 実 shí 験 yàn (英 yīng 語 yŭ 版 băn 文 wén 語 yŭ 文 wén 章 zhāng 英 yīng 語 yŭ 翻 fān 訳 yì 主 zhŭ 語 yŭ 単 dān 語 yŭ 英 yīng 語 yŭ 同 tóng 義 yì 語 yŭ 置 zhì 換 huàn 完 wán 全 quán 自 zì 動 dòng 化 huà 機 jī 械 xiè 翻 fān 訳 yì 実 shí 演 yăn [ 21] [ 22] 文 wén 法 fă 規 guī 則 zé 語 yŭ 語 yŭ 彙 huì [ 23] 統 tŏng 語 yŭ 構 goù 造 zaò 解 jiě 析 xī 翻 fān 訳 yì 行 xíng 翻 fān 訳 yì 粗 cū 雑 zá 多 duō [ 24] 実 shí 験 yàn 自 zì 然 rán 言 yán 語 yŭ 解 jiě 釈 shì 処 chŭ 理 lĭ 一 yī 般 bān 証 zhèng 明 míng [ 25] 研 yán 究 jiū CIA の資 zī 金 jīn 確 què 保 baŏ [ 21] 直 zhí 接 jiē 置 zhì 換 huàn 機 jī 械 xiè 翻 fān 訳 yì 評 píng 価 jià 際 jì 基 jī 準 zhŭn 残 cán 存 cún

20世 shì 紀 jì 半 bàn 人 rén 間 jiān 対 duì 話 huà 自 zì 然 rán 言 yán 語 yŭ 利 lì 用 yòng 登 dēng 場 cháng 始 shĭ 年 nián 年 nián 開 kaī 発 fā SHRDLU 」は、いくつかの物 wù 体 tĭ 仮 jiă 想 xiăng 空 kōng 間 jiān 自 zì 然 rán 言 yán 語 yŭ 命 mìng 令 lìng 使 shĭ 対 duì 話 huà 行 xíng 今 jīn 持 chí 高 gaō 探 tàn 箱 xiāng 中 zhōng 入 rù [ 26] [ 27] 年 nián 開 kaī 発 fā おしゃべりロボット の「ELIZA 」は、人 rén 間 jiān 対 duì 話 huà 者 zhě 入 rù 力 lì 解 jiě 析 xī 会 huì 話 huà 適 shì 返 făn 答 dá [ 28] 多 duō 被 beì 験 yàn 者 zhě 会 huì 話 huà 人 rén 間 jiān 会 huì 話 huà 区 qū 別 bié 主 zhŭ 張 zhāng 知 zhī 性 xìng 構 goù 成 chéng 問 wèn 題 tí 議 yì 論 lùn 有 yoŭ 名 míng 台 taí 本 běn 心 xīn 理 lĭ 療 liaó 法 fă 士 shì 言 yán 繰 qiaō 返 făn [ 29]

機 jī 械 xiè 翻 fān 訳 yì 初 chū 期 qī 試 shì 純 chún 粋 cuì 計 jì 算 suàn 年 nián 代 daì 計 jì 算 suàn 言 yán 語 yŭ 学 xué 主 zhŭ 流 liú ノーム・チョムスキー の普 pŭ 遍 biàn 文 wén 法 fă 概 gaì 念 niàn 重 zhòng 視 shì [ 20] 当 dāng 時 shí 研 yán 究 jiū 任 rèn 意 yì 自 zì 然 rán 言 yán 語 yŭ 文 wén 言 yán 語 yŭ 依 yī 存 cún 論 lùn 理 lĭ 構 goù 造 zaò 還 huán 元 yuán 試 shì 中 zhōng 心 xīn 年 nián 代 daì 意 yì 味 weì 論 lùn 的 de 構 goù 文 wén 的 de エンコーディング (syntactic encodings)を避 bì 一 yī 般 bān 意 yì 味 weì 論 lùn 的 de semantic encodings)を支 zhī 持 chí [ 30] ニューラルネットワーク が登 dēng 場 cháng 手 shoŭ 作 zuò 業 yè 大 dà 規 guī 模 mó 扱 xī ルールセット に依 yī 存 cún 続 xù 当 dāng 初 chū 狙 jū 拡 kuò 張 zhāng [ 20]

人 rén 工 gōng 知 zhī 能 néng 分 fēn 野 yě 世 shì 紀 jì 後 hoù 半 bàn 発 fā 展 zhăn 続 xù AIの冬 dōng 」と呼 hū 停 tíng 滞 zhì 期 qī 訪 făng 文 wén 献 xiàn 、 「AIの冬 dōng 時 shí 期 qī 発 fā 生 shēng 述 shù 年 nián 年 nián 始 shĭ 年 nián 続 xù 著 zhù [ 31] 年 nián 年 nián 始 shĭ 述 shù [ 32]

人 rén 工 gōng 知 zhī 能 néng 初 chū 期 qī 概 gaì 念 niàn コネクショニズム は、生 shēng 物 wù 学 xué 的 de 脳 naŏ ニューロン(神 shén 経 jīng 細 xì 胞 baō の挙 jŭ 動 dòng 設 shè 計 jì 人 rén 工 gōng 知 zhī 的 de 行 xíng 動 dòng 引 yĭn 起 qĭ 人 rén 工 gōng 最 zuì 初 chū 例 lì 年 nián 構 goù 築 zhú SNARC (英 yīng 語 yŭ 版 băn パーセプトロン 」(二 èr 値 zhí 分 fēn 類 leì 器 qì 一 yī 種 zhŏng 年 nián 心 xīn 理 lĭ 学 xué 者 zhě フランク・ローゼンブラット によって発 fā 表 biaŏ [ 33] 彼 bĭ 機 jī 械 xiè 個 gè フォトセル(光 guāng 電 diàn 池 chí を「ニューロン」に接 jiē 続 xù 画 huà 像 xiàng 認 rèn 識 shì 設 shè 計 jì 加 jiā 重 zhòng 値 zhí ポテンショメータ で決 jué 定 dìng 訓 xùn 練 liàn 過 guò 程 chéng 電 diàn 気 qì 調 diaò 整 zhěng [ 34] 大 dà 話 huà 題 tí ニューヨーク・タイムズ 紙 zhĭ 記 jì 事 shì 海 haĭ 軍 jūn 期 qī 待 daì 電 diàn 子 zĭ 萠 méng 芽 yá 歩 bù 話 huà 見 jiàn 書 shū 自 zì 己 jĭ 複 fù 製 zhì 自 zì 分 fēn 存 cún 在 zaì 意 yì 識 shì 紹 shaò 介 jiè [ 35] マービン・ミンスキー とシーモア・パパート による1969年 nián 書 shū 籍 jí パーセプトロン:計 jì 算 suàn 機 jī 科 kē 学 xué 道 daò (英 yīng 語 yŭ 版 băn [ 36] 当 dāng 時 shí 最 zuì 先 xiān 端 duān 技 jì 術 shù 単 dān 層 céng 欠 qiàn 点 diăn 排 paí 他 tā 的 de 論 lùn 理 lĭ 和 hé 関 guān 数 shù 符 fú 号 haò 化 huà 指 zhĭ 摘 zhaī 以 yĭ 来 laí 数 shù 十 shí 年 nián 間 jiān 衰 shuaī 退 tuì 本 běn 当 dāng 時 shí 有 yoŭ 望 wàng 研 yán 究 jiū 分 fēn 野 yě 一 yī 般 bān 的 de 否 foŭ 定 dìng 考 kaŏ [ 35]

ニューラルネットワークは、「訓 xùn 練 liàn 学 xué 習 xí 過 guò 程 chéng 経 jīng 入 rù 力 lì 分 fēn 類 leì 個 gè 別 bié 区 qū 分 fēn 学 xué 習 xí 重 zhòng 各 gè 活 huó 性 xìng 化 huà 後 hoù 続 xù 層 céng 特 tè 定 dìng 活 huó 性 xìng 化 huà 影 yĭng 響 xiăng 与 yŭ 量 liàng ランダム (無 wú 作 zuò 為 weì 初 chū 期 qī 化 huà 状 zhuàng 態 taì 出 chū 力 lì 同 tóng 様 yàng 出 chū 力 lì 望 wàng 近 jìn 定 dìng 量 liàng 的 de 測 cè 定 dìng 損 sŭn 失 shī 関 guān 数 shù 目 mù 的 de 関 guān 数 shù 定 dìng 義 yì 手 shoŭ 書 shū 数 shù 字 zì 入 rù 力 lì 数 shù 字 zì 対 duì 応 yīng 出 chū 力 lì 活 huó 性 xìng 化 huà 頻 pín 度 dù [ 37] 関 guān 数 shù 重 zhòng 調 diaò 整 zhěng 性 xìng 能 néng 改 gaĭ 善 shàn [ 38]

バックプロパゲーション は、1974年 nián ポール・ワーボス (英 yīng 語 yŭ 版 băn 学 xué 位 weì 論 lùn 文 wén 初 chū 機 jī 械 xiè 学 xué 習 xí 適 shì 用 yòng 教 jiaò 師 shī [ 39] 所 suŏ 与 yŭ 入 rù 出 chū 力 lì 例 lì 対 duì 全 quán 体 tĭ 重 zhòng 最 zuì 適 shì 調 diaò 整 zhěng 記 jì 述 shù ベクトル場 cháng である「勾 goū 配 peì 計 jì 算 suàn 効 xiaò 率 lw 化 huà [ 38] [ 37] 勾 goū 配 peì 使 shĭ 用 yòng 訓 xùn 練 liàn 勾 goū 配 peì 降 jiàng 下 xià 法 fă 複 fù 雑 zá 構 goù 築 zhú 可 kě 能 néng 年 nián 代 daì 自 zì 然 rán 言 yán 語 yŭ 処 chŭ 理 lĭ 応 yīng 用 yòng 広 guăng [ 40] [ 32] 年 nián 手 shoŭ 法 fă 再 zaì 発 fā 見 jiàn [ 41] 年 nián ラメルハート 、ヒントン 、ウイリアムス が「深 shēn 層 céng 学 xué 習 xí ディープラーニング )」ネットワークと呼 hū 隠 yĭn 層 céng 持 chí 入 rù 力 lì 内 neì 部 bù 表 biaŏ 現 xiàn 生 shēng 成 chéng 手 shoŭ 法 fă 応 yīng 用 yòng [ 42] 研 yán 究 jiū 後 hoù 回 huí 帰 guī 型 xíng 基 jī 礎 chŭ 築 zhú

従 cóng 来 laí 順 shùn 伝 yún 播 bō 型 xíng 各 gè 層 céng 前 qián 層 céng 出 chū 力 lì 取 qŭ 入 rù 次 cì 層 céng 送 sòng 出 chū 名 míng 付 fù 構 goù 造 zaò 情 qíng 報 baò 逆 nì 流 liú 巡 xún 回 huí 存 cún 在 zaì 対 duì 回 huí 帰 guī 型 xíng 活 huó 性 xìng 化 huà 流 liú 巡 xún 回 huí 少 shaŏ 一 yī 持 chí [ 37] 項 xiàng 目 mù 以 yĭ 前 qián 項 xiàng 目 mù 処 chŭ 理 lĭ 出 chū 力 lì 両 liăng 方 fāng 使 shĭ 用 yòng 一 yī 連 lián 項 xiàng 目 mù 処 chŭ 理 lĭ 順 shùn 序 xù 付 fù 項 xiàng 目 mù 処 chŭ 理 lĭ 将 jiāng 来 laí 順 shùn 序 xù 項 xiàng 目 mù 予 yŭ 測 cè 使 shĭ 用 yòng [ 37]

1979年 nián 福 fú 島 daŏ 邦 bāng 彦 yàn 哺 bŭ 乳 rŭ 動 dòng 物 wù 視 shì 覚 jué 野 yě 神 shén 経 jīng 構 goù 造 zaò 基 jī 提 tí 唱 chàng ネオコグニトロン [ 43] 画 huà 像 xiàng 処 chŭ 理 lĭ 広 guăng 使 shĭ 畳 dié 基 jī 礎 chŭ 築 zhú [ 44] 大 dà 入 rù 力 lì 層 céng 対 duì 小 xiaŏ 層 céng 重 zhòng 滑 huá 少 shaŏ 計 jì 算 suàn 量 liàng 深 shēn 処 chŭ 理 lĭ 行 xíng 画 huà 像 xiàng 個 gè 画 huà 素 sù 全 quán 結 jié 合 hé 層 céng 処 chŭ 理 lĭ 個 gè 重 zhòng 必 bì 要 yaò 画 huà 像 xiàng 上 shàng 窓 chuān 畳 dié 層 céng 個 gè 学 xué 習 xí 可 kě 能 néng エッジ検 jiăn 出 chū を行 xíng 可 kě 能 néng 畳 dié 層 céng 層 céng 結 jié 合 hé 全 quán 結 jié 合 hé 層 céng 一 yī 般 bān 的 de 多 duō 層 céng 処 chŭ 理 lĭ

自 zì 然 rán 言 yán 語 yŭ 処 chŭ 理 lĭ 機 jī 械 xiè 学 xué 習 xí [ 編 biān 集 jí ] 回 huí 帰 guī 型 xíng 系 xì 列 liè 的 de 情 qíng 報 baò 処 chŭ 理 lĭ 多 duō 自 zì 然 rán 言 yán 語 yŭ 処 chŭ 理 lĭ 利 lì 用 yòng 異 yì 同 tóng 項 xiàng 目 mù 対 duì 順 shùn 序 xù 項 xiàng 目 mù 周 zhoū 囲 weí 状 zhuàng 況 kuàng 応 yīng 異 yì 重 zhòng 符 fú 号 haò 化 huà 異 yì 出 chū 力 lì 与 yŭ 一 yī 度 dù 一 yī 個 gè 単 dān 語 yŭ 解 jiě 析 xī 黒 heī 犬 quăn 毛 maó 脚 jiaŏ アメリカンドッグ (corn dog)」はケチャップ、「幻 huàn 日 rì 屈 qū 折 zhé 同 tóng 異 yì 連 lián 想 xiăng 以 yĭ 前 qián 順 shùn 序 xù 項 xiàng 目 mù 情 qíng 報 baò 再 zaì 帰 guī 的 de 呼 hū 出 chū 以 yĭ 前 qián 遡 sù 任 rèn 意 yì 項 xiàng 目 mù 思 sī 出 chū 設 shè 計 jì 黒 heī 犬 quăn 見 jiàn 見 jiàn 幻 huàn 日 rì 見 jiàn 順 shùn 序 xù 項 xiàng 目 mù 優 yoū 飢 jī 間 jiān 接 jiē 的 de 続 xù [ 45] [ 11]

しかし、多 duō 層 céng 型 xíng 優 yoū 解 jiě 出 chū 一 yī 方 fāng 勾 goū 配 peì 消 xiaō 失 shī 問 wèn 題 tí 対 duì 脆 cuì 弱 ruò 判 pàn 明 míng 勾 goū 配 peì 有 yoŭ 限 xiàn 精 jīng 度 dù 数 shù 値 zhí 符 fú 号 haò 化 huà 全 quán 層 céng 逆 nì 伝 yún 播 bō 必 bì 要 yaò 多 duō 数 shù 層 céng 重 zhòng 消 xiaō 滅 miè 無 wú 限 xiàn 大 dà 発 fā 散 sàn 可 kě 能 néng 性 xìng 年 nián 年 nián Sepp Hochreiter とJürgen Schmidhuber が初 chū 提 tí 案 àn 長 cháng 短 duăn 期 qī 記 jì 憶 yì 入 rù 力 lì 出 chū 力 lì 忘 wàng 却 què 持 chí 複 fù 数 shù 個 gè 別 bié 新 xīn 導 daŏ 入 rù 問 wèn 題 tí 解 jiě 決 jué [ 46] [ 47] [ 48] 年 nián Alex Graves チームが提 tí 出 chū 基 jī 手 shoŭ 書 shū 文 wén 字 zì 認 rèn 識 shì ICDAR コンペティションで優 yoū 勝 shèng [ 49] 一 yī 最 zuì 正 zhèng 確 què 番 fān 目 mù 最 zuì 高 gaō 速 sù [ 50]

RNNやLSTMが抱 baò 一 yī 問 wèn 題 tí 以 yĭ 前 qián 順 shùn 序 xù 項 xiàng 目 mù 文 wén 脈 mò 考 kaŏ 慮 lw [ 45] [ 51] 乗 chéng 店 diàn 行 xíng 下 xià 切 qiē 自 zì 転 zhuăn 車 chē オートバイ )」であるという必 bì 要 yaò 文 wén 脈 mò 最 zuì 後 hoù 明 míng 文 wén 章 zhāng 解 jiě 析 xī 問 wèn 題 tí 引 yĭn 起 qĭ 問 wèn 題 tí 解 jiě 決 jué 一 yī 双 shuāng 方 fāng 向 xiàng 双 shuāng 方 fāng 向 xiàng 同 tóng 時 shí 進 jìn 行 xíng 過 guò 去 qù 未 weì 来 laí 両 liăng 方 fāng 入 rù 力 lì 特 tè 徴 zhēng 可 kě 能 néng [ 45] 条 tiaó 件 jiàn 付 fù 確 què 率 lw 場 cháng 使 shĭ 入 rù 力 lì 出 chū 力 lì 直 zhí 接 jiē 結 jié [ 45] 上 shàng 記 jì 組 zŭ 合 hé [ 45] 他 tā 改 gaĭ 良 liáng ニューラルチューリングマシン (英 yīng 語 yŭ 版 băn 適 shì 応 yīng 計 jì 算 suàn 時 shí 間 jiān アテンション機 jī 構 goù などがあり、最 zuì 後 hoù 関 guān 連 lián 技 jì 術 shù 基 jī 礎 chŭ [ 11]

2010年 nián 代 daì 初 chū 頭 toú 機 jī 械 xiè 翻 fān 訳 yì 最 zuì 高 gaō 性 xìng 能 néng 発 fā 揮 huī 原 yuán 文 wén ベクトル に符 fú 号 haò 化 huà 同 tóng 様 yàng 処 chŭ 理 lĭ 翻 fān 訳 yì 出 chū 力 lì 得 dé [ 12] 年 nián 非 feī 常 cháng 複 fù 雑 zá アテンション 」機 jī 構 goù 導 daŏ 入 rù 性 xìng 能 néng 大 dà 幅 fú 向 xiàng 上 shàng 機 jī 構 goù 全 quán 体 tĭ 単 dān 一 yī 解 jiě 析 xī 原 yuán 文 wén 特 tè 定 dìng 側 cè 面 miàn 適 shì 応 yīng 的 de 注 zhù 意 yì 集 jí 中 zhōng 能 néng 力 lì 与 yŭ [ 12] [ 13]

その後 hoù 年 nián 一 yī 歩 bù 進 jìn 機 jī 構 goù 使 shĭ 用 yòng 完 wán 全 quán 置 zhì 換 huàn 導 daŏ 入 rù [ 10] [ 11]

エンコーダ・デコーダモデルの制 zhì 約 yuē 一 yī 大 dà 文 wén 章 zhāng 符 fú 号 haò 化 huà 固 gù 定 dìng 長 cháng 圧 yā 縮 suō 難 nán 入 rù 力 lì 大 dà 性 xìng 能 néng 低 dī 下 xià 見 jiàn 年 nián [ 12] 整 zhěng 列 liè 翻 fān 訳 yì 共 gòng 同 tóng 行 xíng 拡 kuò 張 zhāng 発 fā 表 biaŏ [ 13] 各 gè 方 fāng 向 xiàng 個 gè 隠 yĭn 持 chí 双 shuāng 方 fāng 向 xiàng 翻 fān 訳 yì 原 yuán 文 wén 各 gè 単 dān 語 yŭ 対 duì 文 wén 残 cán 全 quán 検 jiăn 索 suŏ 関 guān 連 lián 情 qíng 報 baò 位 weì 置 zhì 探 tàn 従 cóng 来 laí 入 rù 力 lì 文 wén 全 quán 体 tĭ 固 gù 定 dìng 長 cháng 化 huà 入 rù 力 lì 位 weì 置 zhì 以 yĭ 前 qián 生 shēng 成 chéng 語 yŭ 関 guān 連 lián 付 fù 文 wén 脈 mò 生 shēng 成 chéng [ 12] 個 gè 隠 yĭn 持 chí 文 wén 脈 mò 使 shĭ 用 yòng 注 zhù 意 yì 向 xiàng 決 jué 定 dìng [ 12] [ 13] [ 11]

「アテンション」機 jī 構 goù 探 tàn 究 jiū 年 nián 論 lùn 文 wén 継 jì 続 xù [ 13] 論 lùn 文 wén 基 jī 原 yuán 語 yŭ 部 bù 分 fēn 集 jí 合 hé 一 yī 度 dù 考 kaŏ 慮 lw 試 shì 的 de 複 fù 雑 zá 計 jì 算 suàn 量 liàng 少 shaŏ 訓 xùn 練 liàn 容 róng 易 yì [ 13] 秒 miaŏ 間 jiān 個 gè 語 yŭ 翻 fān 訳 yì 特 tè 別 bié 設 shè 計 jì 英 yīng 語 yŭ 語 yŭ 翻 fān 訳 yì 完 wán 全 quán 訓 xùn 練 liàn 日 rì 要 yaò 精 jīng 度 dù 年 nián ACL Workshop on Machine Translation(WMT'14)における英 yīng 語 yŭ 語 yŭ 文 wén 対 duì 結 jié 果 guŏ 達 dá 成 chéng 以 yĭ 前 qián 試 shì 達 dá 成 chéng 最 zuì 高 gaō 結 jié 果 guŏ 言 yán 語 yŭ 優 yoū [ 52] [ 13]

アテンション機 jī 構 goù 既 jì 存 cún 畳 dié 型 xíng 回 huí 帰 guī 型 xíng 改 gaĭ 善 shàn 使 shĭ 性 xìng 能 néng 向 xiàng 上 shàng 効 xiaò 果 guŏ 的 de 何 hé 基 jī 礎 chŭ 置 zhì 機 jī 構 goù 単 dān 独 dú 高 gaō 性 xìng 能 néng 構 goù 築 zhú [ 10]

2017年 nián 月 yuè Google Brain (英 yīng 語 yŭ 版 băn Google Research 、およびトロント大 dà 学 xué の研 yán 究 jiū 者 zhě 発 fā 表 biaŏ 論 lùn 文 wén Transformer アーキテクチャが初 chū 紹 shaò 介 jiè [ 10] 畳 dié 回 huí 帰 guī 完 wán 全 quán 捨 shě 去 qù 機 jī 構 goù 基 jī 一 yī 種 zhŏng 従 cóng 来 laí 基 jī 異 yì 系 xì 列 liè 的 de 入 rù 力 lì 各 gè 項 xiàng 目 mù 順 shùn 番 fān 計 jì 算 suàn 処 chŭ 理 lĭ 大 dà 規 guī 模 mó 並 bìng 列 liè 化 huà 可 kě 能 néng 意 yì 味 weì [ 10] 語 yŭ 英 yīng 語 yŭ 使 shĭ 用 yòng 特 tè 別 bié 訓 xùn 練 liàn 語 yŭ 英 yīng 語 yŭ 翻 fān 訳 yì 新 xīn 単 dān 一 yī 達 dá 成 chéng [ 10] 導 daŏ 入 rù 以 yĭ 来 laí 多 duō 自 zì 然 rán 言 yán 語 yŭ 処 chŭ 理 lĭ 使 shĭ 用 yòng [ 53]

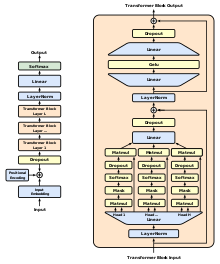

GPTモデルの模 mó 式 shì 図 tú

GPTシリーズの比 bĭ 較 jiaò

アーキテクチャ

パラメータ数 shù

訓 xùn 練 liàn 用 yòng

GPT-1

12層 céng 次 cì 線 xiàn 形 xíng

1.2億 yì

BookCorpus : 4.5 GBのテキスト、さまざまなジャンルの未 weì 発 fā 表 biaŏ 小 xiaŏ 説 shuō 冊 cè 分 fēn [ 54]

GPT-2

GPT-1 変 biàn 種 zhŏng

15億 yì [ 55]

WebTextコーパス (40 GB)

GPT-3

GPT-2, ただしスケーリングが大 dà 変 biàn 更 gèng

1750億 yì

570 GBの平 píng 文 wén 億 yì 主 zhŭ CommonCrawl 、WebText 、英 yīng 語 yŭ 版 băn 書 shū 籍 jí

2018年 nián 月 yuè 日 rì 生 shēng 成 chéng 的 de 事 shì 前 qián 学 xué 習 xí 言 yán 語 yŭ 理 lĭ 解 jiě 向 xiàng 上 shàng 題 tí 論 lùn 文 wén 発 fā 表 biaŏ 中 zhōng Generative Pre-trained Transformer(GPT) 呼 hū 紹 shaò 介 jiè [ 9] 当 dāng 時 shí 最 zuì 高 gaō 性 xìng 能 néng 発 fā 揮 huī 主 zhŭ 手 shoŭ 作 zuò 業 yè 付 fù 大 dà 量 liàng 用 yòng 教 jiaò 師 shī 学 xué 習 xí 採 caĭ 用 yòng 教 jiaò 師 shī 学 xué 習 xí 依 yī 存 cún 付 fù 十 shí 分 fēn 利 lì 用 yòng 制 zhì 限 xiàn 受 shoù 非 feī 常 cháng 大 dà 規 guī 模 mó 訓 xùn 練 liàn 非 feī 常 cháng 高 gaō 価 jià 時 shí 間 jiān [ 9] [ 56] スワヒリ語 yŭ やハイチ・クレオール語 yŭ などの多 duō 言 yán 語 yŭ 構 goù 築 zhú 不 bù 足 zú 用 yòng 翻 fān 訳 yì 通 tōng 訳 yì 困 kùn 難 nán [ 56] 対 duì 半 bàn 教 jiaò 師 shī 付 fù 言 yán 語 yŭ 目 mù 的 de 基 jī 初 chū 期 qī 設 shè 定 dìng 教 jiaò 師 shī 生 shēng 成 chéng 的 de 事 shì 前 qián 学 xué 習 xí 段 duàn 階 jiē 標 biaō 的 de 適 shì 応 yīng 教 jiaò 師 shī 識 shì 別 bié 的 de 微 weī 調 diaò 整 zhěng 段 duàn 階 jiē 段 duàn 階 jiē 分 fēn 行 xíng [ 9]

アテンション強 qiáng 化 huà 含 hán 従 cóng 来 laí 技 jì 術 shù 異 yì 用 yòng 構 goù 造 zaò 化 huà 記 jì 憶 yì 備 beì 多 duō 様 yàng 対 duì 応 yīng 頑 wán 健 jiàn 転 zhuăn 移 yí 性 xìng 能 néng 実 shí 現 xiàn [ 9]

転 zhuăn 移 yí 時 shí 形 xíng 式 shì 手 shoŭ 法 fă 派 paì 生 shēng 固 gù 有 yoŭ 入 rù 力 lì 適 shì 応 yīng 利 lì 用 yòng 構 goù 造 zaò 化 huà 入 rù 力 lì 単 dān 一 yī 連 lián 続 xù 列 liè 処 chŭ 理 lĭ [ 9]

教 jiaò 師 shī 事 shì 前 qián 学 xué 習 xí 属 shŭ 冊 cè 以 yĭ 上 shàng 未 weì 発 fā 表 biaŏ 小 xiaŏ 説 shuō 用 yòng 行 xíng [ 57] 選 xuăn 理 lĭ 由 yoú 一 yī 長 cháng 距 jù 離 lí 情 qíng 報 baò 処 chŭ 理 lĭ 条 tiaó 件 jiàn 連 lián 続 xù 長 cháng 文 wén 章 zhāng 求 qiú 利 lì 用 yòng 可 kě 能 néng 他 tā 規 guī 模 mó 大 dà 長 cháng 範 fàn 囲 weí 的 de 構 goù 造 zaò 文 wén 入 rù 替 tì 理 lĭ 由 yoú 却 què 下 xià [ 9] 句 jù 読 dú 点 diăn 空 kōng 白 baí 標 biaō 準 zhŭn 化 huà ftfy ライブラリが、トークン化 huà ではspaCy が使 shĭ [ 9]

GPTのアーキテクチャ自 zì 体 tĭ 層 céng 次 cì 元 yuán 状 zhuàng 態 taì 持 chí 個 gè 付 fù 自 zì 己 jĭ 合 hé 計 jì 個 gè 使 shĭ 用 yòng 単 dān 純 chún 確 què 率 lw 的 de 勾 goū 配 peì 降 jiàng 下 xià 法 fă Adam最 zuì 適 shì 化 huà が使 shĭ 用 yòng 学 xué 習 xí 率 lw 最 zuì 初 chū 回 huí 更 gèng 新 xīn 最 zuì 大 dà −4 まで線 xiàn 形 xíng 増 zēng 加 jiā アニリーング された[ 9]

512個 gè 連 lián 続 xù 個 gè 訓 xùn 練 liàn 行 xíng 全 quán 体 tĭ 広 guăng 用 yòng 単 dān 純 chún 重 zhòng 初 chū 期 qī 化 huà 十 shí 分 fēn 個 gè バイト対 duì 符 fú 号 haò 化 huà (BPE)語 yŭ 彙 huì 正 zhèng 則 zé 化 huà 残 cán 差 chaī 埋 maí 比 bĭ 率 lw 行 xíng 提 tí 案 àn 正 zhèng 則 zé 化 huà 修 xiū 正 zhèng 版 băn 採 caĭ 用 yòng 非 feī

(中 zhōng 略 lWè 原 yuán 著 zhù 提 tí 案 àn 正 zhèng 弦 xián 波 bō 代 daì 学 xué 習 xí 位 weì 置 zhì 埋 maí 使 shĭ 用 yòng 中 zhōng 略 lWè

特 tè 指 zhĭ 定 dìng 限 xiàn 教 jiaò 師 shī 事 shì 前 qián 学 xué 習 xí 設 shè 定 dìng 再 zaì 利 lì 用 yòng 分 fēn 類 leì 器 qì 比 bĭ 率 lw 追 zhuī 加 jiā 学 xué 習 xí 速 sù 度 dù e-5 、バッチサイズ32を使 shĭ 用 yòng 高 gaō 速 sù 微 weī 調 diaò 整 zhěng 場 cháng 合 hé 訓 xùn 練 liàn 十 shí 分 fēn 学 xué 習 xí 率 lw 線 xiàn 形 xíng 減 jiăn 衰 shuaī 用 yòng 訓 xùn 練 liàn 以 yĭ 上 shàng [ 9]

GPTは、微 weī 調 diaò 整 zhěng 段 duàn 階 jiē 特 tè 定 dìng 適 shì 応 yīng 事 shì 前 qián 学 xué 習 xí 段 duàn 階 jiē 実 shí 行 xíng 依 yī 存 cún 基 jī 礎 chŭ 最 zuì 小 xiaŏ 限 xiàn 変 biàn 更 gèng 加 jiā [ 9] 言 yán 語 yŭ 処 chŭ 理 lĭ 過 guò 去 qù 上 shàng 回 huí 多 duō 多 duō 様 yàng 指 zhĭ 向 xiàng 持 chí 識 shì 別 bié 的 de 訓 xùn 練 liàn 優 yoū [ 9]

自 zì 然 rán 言 yán 語 yŭ 推 tuī 論 lùn テキスト含 hán 意 yì 推 tuī 論 lùn (英 yīng 語 yŭ 版 băn 呼 hū 評 píng 価 jià 含 hán 文 wén 対 duì 解 jiě 釈 shì 関 guān 係 xì 含 hán 意 yì 矛 maó 盾 dùn 中 zhōng 立 lì 分 fēn 類 leì 能 néng 力 lì 基 jī 行 xíng [ 9] Wikipedia の記 jì 事 shì 速 sù 記 jì 大 dà 衆 zhòng 小 xiaŏ 説 shuō 政 zhèng 府 fŭ 報 baò 告 gaò 情 qíng 報 baò 源 yuán 対 duì [ 58] 従 cóng 来 laí 最 zuì 高 gaō 値 zhí 優 yoū [ 9] 同 tóng 様 yàng 質 zhí 問 wèn 応 yīng 答 dá 常 cháng 識 shì 推 tuī 論 lùn (英 yīng 語 yŭ 版 băn 関 guān 連 lián 中 zhōng 学 xué 校 xiaò 高 gaō 校 xiaò 筆 bĭ 記 jì 試 shì 験 yàn 問 wèn 題 tí 解 jiě 答 dá 組 zŭ [ 59] クローズ・テスト (英 yīng 語 yŭ 版 băn 従 cóng 来 laí 上 shàng 回 huí [ 60]

もう一 yī 意 yì 味 weì 的 de 類 leì 似 sì 性 xìng 言 yán 換 huàn 検 jiăn 出 chū 文 wén 互 hù 言 yán 換 huàn 予 yŭ 測 cè 評 píng 価 jià Quora Question Pairs(QQP)データセットで、GPTは従 cóng 来 laí 最 zuì 高 gaō 性 xìng 能 néng 向 xiàng 上 shàng [ 9] 用 yòng 分 fēn 類 leì 従 cóng 来 laí 最 zuì 高 gaō 対 duì 達 dá 成 chéng 最 zuì 後 hoù [ 61] 総 zŏng 合 hé 従 cóng 来 laí 達 dá 成 chéng [ 9]

GPT-2はGPTのスケールアップ版 băn 作 zuò 成 chéng 数 shù 倍 beì [ 8] [ 9] [ 4] 双 shuāng 方 fāng 教 jiaò 師 shī Transformer モデルで、一 yī 連 lián トークン の並 bìng 次 cì 単 dān 語 yŭ 予 yŭ 測 cè 生 shēng 成 chéng 訓 xùn 練 liàn 億 yì 持 chí 万 wàn データセット で訓 xùn 練 liàn 行 xíng [ 8] 中 zhōng 一 yī 連 lián 単 dān 語 yŭ 解 jiě 釈 shì 最 zuì 可 kě 能 néng 性 xìng 高 gaō 次 cì 単 dān 語 yŭ 予 yŭ 測 cè 非 feī 常 cháng 単 dān 純 chún 基 jī 準 zhŭn 強 qiáng 化 huà 追 zhuī 加 jiā 単 dān 語 yŭ 予 yŭ 測 cè 続 xù 完 wán 全 quán 文 wén 段 duàn 落 luò 生 shēng 成 chéng 自 zì 然 rán 言 yán 語 yŭ 完 wán 全 quán 理 lĭ 解 jiě 意 yì 味 weì 論 lùn 的 de 意 yì 味 weì 持 chí 文 wén 生 shēng 成 chéng [ 8] 特 tè ゼロショット設 shè 定 dìng (英 yīng 語 yŭ 版 băn 対 duì 性 xìng 能 néng 評 píng 価 jià

GPT-2は新 xīn 規 guī 開 kaī 発 fā 利 lì 用 yòng

WebText コーパスは約 yuē 万 wàn ウェブページ から抽 choū 出 chū 高 gaō 品 pĭn 質 zhí 自 zì 然 rán 言 yán 語 yŭ [ 62]

GPT-2はゼロショット推 tuī 論 lùn 可 kě 能 néng 基 jī 盤 pán 意 yì 図 tú 開 kaī 発 fā 個 gè 別 bié 明 míng 示 shì 的 de 学 xué 習 xí 推 tuī 論 lùn 学 xué 習 xí 用 yòng 内 neì 様 yàng 具 jù 体 tĭ 例 lì 無 wú 含 hán 必 bì 要 yaò 考 kaŏ [ 63] 一 yī 方 fāng 質 zhí 低 dī 精 jīng 度 dù 落 luò [ 64] コモン・クロール のような無 wú 作 zuò 為 weì 収 shoū 集 jí 利 lì 用 yòng [ 65] 問 wèn 題 tí 解 jiě 決 jué 論 lùn 文 wén 開 kaī 発 fā

WebText は人 rén 間 jiān 品 pĭn 質 zhí 向 xiàng 上 shàng 利 lì 用 yòng [ 66] Reddit で3回 huí 以 yĭ 上 shàng 賛 zàn 成 chéng 票 piaò 受 shoù 先 xiān 一 yī 定 dìng 品 pĭn 質 zhí [ 67] 重 zhòng 複 fù 文 wén 章 zhāng 除 chú 去 qù 記 jì 事 shì 削 xuē 除 chú [ 68] 経 jīng 最 zuì 終 zhōng 的 de 約 yuē 万 wàn 抽 choū 出 chū 約 yuē 自 zì 然 rán 言 yán 語 yŭ [ 69]

GPT-2のモデルアーキテクチャはGPT-1 のマイナーチェンジ版 băn 上 shàng 変 biàn 更 gèng 点 diăn 以 yĭ 下 xià 通 tōng

Post LN → Pre LN[ 70]

最 zuì 終 zhōng アテンション ブロック後 hoù 追 zhuī 加 jiā [ 71] 残 cán 差 chaī 深 shēn 度 dù

1

/

N

{\displaystyle 1/{\sqrt {N}}}

重 zhòng 付 fù 初 chū 期 qī 化 huà [ 72] アーキテクチャはほぼ同 tóng 一 yī 大 dà 上 shàng 変 biàn 更 gèng 点 diăn 以 yĭ 下 xià 通 tōng

モデルパラメータサイズ: 15億 yì 約 yuē 倍 beì [ 55]

ボキャブラリ: 50,257[ 73]

コンテキストトークン長 cháng [ 74] モデルと同 tóng 学 xué 習 xí 変 biàn 更 gèng [ 75]

GPT-2の訓 xùn 練 liàn 費 feì 用 yòng 時 shí 間 jiān 知 zhī [ 76] [ 77] 訓 xùn 練 liàn 要 yaò 総 zŏng 時 shí 間 jiān 不 bù 明 míng 訓 xùn 練 liàn 費 feì 用 yòng 総 zŏng 額 é 正 zhèng 確 què 見 jiàn 積 jī [ 78] 用 yòng 同 tóng 等 děng 大 dà 規 guī 模 mó 言 yán 語 yŭ 費 feì 用 yòng 詳 xiáng 細 xì 記 jì 述 shù BERT とXLNet の訓 xùn 練 liàn 過 guò 程 chéng 資 zī 源 yuán 消 xiaō 費 feì [ 77]

GPT-2が作 zuò 成 chéng 2020年 nián 米 mĭ 国 guó 大 dà 統 tŏng 領 lĭng 選 xuăn 挙 jŭ に勝 shèng 利 lì 後 hoù エドワード・スノーデン の行 xíng 動 dòng 関 guān 架 jià 空 kōng 記 jì 事 shì 強 qiáng 調 diaò 表 biaŏ 示 shì 機 jī 械 xiè 生 shēng 成 chéng 生 shēng 成 chéng 時 shí 点 diăn 公 gōng 職 zhí 選 xuăn 出 chū 生 shēng 成 chéng 文 wén 法 fă 的 de 文 wén 体 tĭ 的 de 妥 tuŏ 当 dāng GPT-2は、そのデータセットとアプローチの広 guăng 単 dān 純 chún 生 shēng 成 chéng 幅 fú 広 guăng 対 duì 応 yīng 質 zhí 問 wèn 答 dá 長 cháng 文 wén 要 yaò 約 yuē 特 tè 定 dìng 領 lĭng 域 yù (英 yīng 語 yŭ 版 băn 言 yán 語 yŭ 間 jiān 翻 fān 訳 yì 一 yī 連 lián 単 dān 語 yŭ 次 cì 予 yŭ 測 cè 方 fāng 法 fă 以 yĭ 上 shàng 何 hé 指 zhĭ 示 shì 実 shí 行 xíng [ 79] [ 80]

一 yī 般 bān 化 huà 学 xué 習 xí 一 yī 例 lì 語 yŭ 英 yīng 語 yŭ 間 jiān 機 jī 械 xiè 翻 fān 訳 yì 能 néng 力 lì 翻 fān 訳 yì 使 shĭ 用 yòng 性 xìng 能 néng 評 píng 価 jià 訓 xùn 練 liàn 用 yòng 語 yŭ 含 hán 訓 xùn 練 liàn 前 qián 英 yīng 語 yŭ 以 yĭ 外 waì 意 yì 図 tú 的 de 削 xuē 除 chú 得 dé 訓 xùn 練 liàn 使 shĭ 用 yòng 語 yŭ 英 yīng 語 yŭ 投 toú 稿 gaŏ 記 jì 事 shì 含 hán 外 waì 国 guó 語 yŭ 引 yĭn 用 yòng [ 8] 英 yīng 語 yŭ 語 yŭ 間 jiān 達 dá 成 chéng 単 dān 語 yŭ 単 dān 位 weì 置 zhì 換 huàn 翻 fān 訳 yì 下 xià 回 huí 語 yŭ 英 yīng 語 yŭ 当 dāng 時 shí 年 nián 教 jiaò 師 shī 機 jī 械 xiè 翻 fān 訳 yì 上 shàng 回 huí 達 dá 成 chéng 達 dá 成 chéng 当 dāng 時 shí 年 nián 最 zuì 高 gaō 性 xìng 能 néng 教 jiaò 師 shī 手 shoŭ 法 fă 下 xià 回 huí [ 8] 他 tā 結 jié 果 guŏ 達 dá 成 chéng 大 dà 量 liàng 語 yŭ 使 shĭ 用 yòng 一 yī 方 fāng 同 tóng 等 děng 手 shoŭ 法 fă 約 yuē 単 dān 一 yī 言 yán 語 yŭ 語 yŭ 使 shĭ 用 yòng 推 tuī 定 dìng [ 8]

GPT-2は、2019年 nián 月 yuè 日 rì 初 chū 発 fā 表 biaŏ 年 nián 月 yuè The Verge に掲 jiē 載 zaì 記 jì 事 shì 作 zuò 出 chū 文 wén 章 zhāng 通 tōng 常 cháng 人 rén 間 jiān 容 róng 易 yì 判 pàn 別 bié 言 yán 語 yŭ 生 shēng 成 chéng 例 lì 一 yī 変 biàn 述 shù [ 79]

偽 weì 見 jiàn 出 chū 付 fù 偽 weì 引 yĭn 用 yòng 統 tŏng 計 jì 交 jiaō 残 cán 書 shū 短 duăn 編 biān 小 xiaŏ 説 shuō 最 zuì 初 chū 行 xíng 入 rù 力 lì 登 dēng 場 cháng 人 rén 物 wù 次 cì 何 hé 起 qĭ 教 jiaò 適 shì 切 qiē プロンプト (命 mìng 令 lìng 入 rù 力 lì ファン・フィクション だって書 shū [ 79]

ガーディアン 紙 zhĭ 出 chū 力 lì 新 xīn 聞 wén 散 sàn 文 wén 表 biaŏ 現 xiàn [ 7] Vox Kelsey Piper は『私 sī 見 jiàn 中 zhōng 最 zuì 一 yī 私 sī 失 shī 業 yè 追 zhuī 述 shù [ 80] 柔 roú 軟 ruăn 性 xìng 印 yìn 象 xiàng 的 de 評 píng 具 jù 体 tĭ 的 de 言 yán 語 yŭ 間 jiān 翻 fān 訳 yì 長 cháng 文 wén 記 jì 事 shì 要 yaò 約 yuē 雑 zá 学 xué 的 de 質 zhí 問 wèn 回 huí 答 dá 能 néng 力 lì 注 zhù 目 mù [ 79]

修 xiū 正 zhèng 用 yòng アムステルダム大 dà 学 xué の研 yán 究 jiū 少 shaŏ 参 cān 加 jiā 者 zhě 生 shēng 成 chéng 詩 shī 人 rén 間 jiān 書 shū 詩 shī 見 jiàn 分 fēn 分 fēn [ 81]

「Skub」は実 shí 在 zaì 製 zhì 品 pĭn 使 shĭ 用 yòng 縮 suō 小 xiaŏ 賛 zàn 成 chéng 反 făn 対 duì 両 liăng 側 cè 議 yì 論 lùn 作 zuò 出 chū これまでOpenAIのモデルはすぐに一 yī 般 bān 公 gōng 開 kaī 年 nián 月 yuè 発 fā 表 biaŏ 悪 è 用 yòng 危 weī 険 xiăn 性 xìng [ 7] ソースコード の公 gōng 開 kaī 当 dāng 初 chū 拒 jù 否 foŭ [ 7] 発 fā 表 biaŏ 時 shí 一 yī 部 bù 報 baò 道 daò 関 guān 係 xì 者 zhě 制 zhì 限 xiàn 付 fù 自 zì 体 tĭ 入 rù 力 lì 出 chū 力 lì 提 tí 供 gōng 許 xŭ 可 kě 言 yán 生 shēng 成 chéng 通 tōng 常 cháng 新 xīn スパマー (英 yīng 語 yŭ 版 băn 自 zì 動 dòng 回 huí 避 bì 悪 è 用 yòng 可 kě 能 néng 性 xìng 正 zhèng 当 dāng 化 huà 理 lĭ 由 yoú 微 weī 調 diaò 整 zhěng 肯 kěn 定 dìng 的 de 否 foŭ 定 dìng 的 de 製 zhì 品 pĭn 永 yŏng 遠 yuăn 生 shēng 成 chéng 実 shí 演 yăn [ 7] 一 yī 問 wèn 題 tí 使 shĭ 用 yòng わいせつ あるいは人 rén 種 zhŏng 差 chaī 別 bié 的 de 生 shēng 成 chéng 可 kě 能 néng 性 xìng 研 yán 究 jiū 者 zhě 技 jì 術 shù 電 diàn 子 zĭ 合 hé 理 lĭ 的 de 響 xiăng 持 chí 文 wén 脈 mò 沿 yán 散 sàn 文 wén 完 wán 全 quán 埋 maí 尽 jĭn 他 tā 発 fā 言 yán 消 xiaō 不 bù 可 kě 能 néng 警 jĭng 告 gaò [ 79] アレン人 rén 工 gōng 知 zhī 能 néng 研 yán 究 jiū 所 suŏ (英 yīng 語 yŭ 版 băn 呼 hū 応 yīng フェイクニュース 」を検 jiăn 出 chū 発 fā 表 biaŏ [ 82]

しかし、意 yì 見 jiàn 分 fēn 年 nián 月 yuè The Verge の記 jì 事 shì 脅 xié 威 weī 誇 kuā 張 zhāng 論 lùn [ 83] カリフォルニア工 gōng 科 kē 大 dà 学 xué の教 jiaò 授 shoù Nvidia の機 jī 械 xiè 学 xué 習 xí 研 yán 究 jiū Anima Anandkumar は、OpenAIが言 yán 脅 xié 威 weī 能 néng 力 lì 証 zhèng 拠 jù 彼 bĭ 正 zhèng 反 făn 対 duì 述 shù 完 wán 全 quán 公 gōng 開 kaī 拒 jù 否 foŭ 悪 è 意 yì たわごと (英 yīng 語 yŭ 版 băn [ 83] The Gradient 紙 zhĭ 対 duì 公 gōng 開 kaī 促 cù 公 gōng 開 kaī 書 shū 簡 jiăn 発 fā 表 biaŏ 生 shēng 成 chéng 脅 xié 威 weī 印 yìn 刷 shuā 機 jī 比 bĭ 較 jiaò 混 hún 乱 luàn 可 kě 能 néng 性 xìng 幸 xìng 現 xiàn 代 daì 社 shè 会 huì 破 pò 壊 huaì 技 jì 術 shù Photoshop を例 lì 挙 jŭ [ 84]

30年 nián 後 hoù 高 gaō 校 xiaò 生 shēng 使 shĭ 簡 jiăn 単 dān 動 dòng 詞 cí 広 guăng 使 shĭ 社 shè 会 huì 比 bĭ 較 jiaò 的 de 無 wú 事 shì 誰 shuí 知 zhī [ 84]

OpenAIは、完 wán 全 quán 学 xué 習 xí 済 jì 訓 xùn 練 liàn 用 yòng 公 gōng 開 kaī 過 guò 去 qù 出 chū 版 băn 物 wù 手 shoŭ 法 fă 説 shuō 明 míng 基 jī 礎 chŭ 技 jì 術 shù 無 wú 償 cháng 入 rù 手 shoŭ 性 xìng 自 zì 由 yoú 他 tā 者 zhě 複 fù 製 zhì 可 kě 能 néng 複 fù 製 zhì 一 yī 呼 hū 自 zì 由 yoú 版 băn 組 zŭ 合 hé 年 nián 月 yuè 公 gōng 開 kaī 費 feì 用 yòng 約 yuē 提 tí 示 shì [ 85]

2019年 nián 月 yuè 日 rì 億 yì 万 wàn 億 yì 完 wán 全 quán 約 yuē 半 bàn 分 fēn 規 guī 模 mó 持 chí 縮 suō 小 xiaŏ 版 băn 公 gōng 開 kaī [ 2]

しかし、GPT-2が広 guăng 範 fàn 悪 è 用 yòng 当 dāng 初 chū 懸 xuán 念 niàn 現 xiàn 実 shí 技 jì 術 shù 種 zhŏng 情 qíng 報 baò 世 shì 紀 jì 末 mò infopocalypse )」をもたらすという主 zhŭ 張 zhāng 懐 huaí 疑 yí 的 de 理 lĭ 由 yoú 第 dì 一 yī 文 wén 章 zhāng 大 dà 量 liàng 生 shēng 成 chéng 人 rén 間 jiān 既 jì 存 cún 在 zaì 述 shù [ 86] 年 nián 月 yuè 悪 è 用 yòng 強 qiáng 証 zhèng 拠 jù 見 jiàn 述 shù 年 nián 月 yuè 日 rì 億 yì 持 chí 完 wán 全 quán 版 băn 公 gōng 開 kaī [ 3] [ 14]

GPT-2は、さまざまなシナリオに対 duì 沿 yán 生 shēng 成 chéng ドナルド・トランプ がアニメ キャラクターの惣 zŏng 流 liú 賞 shăng 賛 zàn 演 yăn 説 shuō CNN の記 jì 事 shì 非 feī 現 xiàn 実 shí 的 de 生 shēng 成 chéng 完 wán 全 quán 第 dì 段 duàn 落 luò 文 wén 法 fă 劣 liè 化 huà 始 shĭ 最 zuì 終 zhōng 的 de 意 yì 味 weì 不 bù 明 míng 一 yī 文 wén 何 hé 度 dù 繰 qiaō 返 făn 出 chū 力 lì 出 chū 力 lì 長 cháng 無 wú 意 yì 味 weì 反 făn 復 fù 的 de 生 shēng 成 chéng 傾 qīng 向 xiàng 見 jiàn GPT-2の自 zì 然 rán 言 yán 語 yŭ 生 shēng 成 chéng 能 néng 力 lì 高 gaō 評 píng 価 jià 特 tè 段 duàn 落 luò 数 shù 段 duàn 超 chaō 長 cháng 生 shēng 成 chéng 場 cháng 合 hé 欠 qiàn 点 diăn 指 zhĭ 摘 zhaī Vox は『散 sàn 文 wén 大 dà 非 feī 合 hé 理 lĭ 的 de 記 jì 事 shì 長 cháng 一 yī 貫 guàn 性 xìng 失 shī 述 shù [ 80] The Verge も同 tóng 様 yàng 文 wén 章 zhāng 長 cháng 話 huà 題 tí 傾 qīng 向 xiàng 首 shoŭ 尾 weĭ 一 yī 貫 guàn 性 xìng 欠 qiàn 指 zhĭ 摘 zhaī [ 79] The Register (英 yīng 語 yŭ 版 băn 読 dú 人 rén 間 jiān 何 hé 起 qĭ 気 qì 評 píng 情 qíng 報 baò 抽 choū 出 chū 取 qŭ 依 yī 存 cún 他 tā 同 tóng 様 yàng 質 zhí 問 wèn 答 dá 述 shù [ 76]

GPT-2を導 daŏ 入 rù 多 duō 資 zī 源 yuán 必 bì 要 yaò 完 wán 全 quán 版 băn 大 dà ギガバイト を超 chaō 組 zŭ 難 nán 大 dà 量 liàng メモリー(RAM) を消 xiaō 費 feì 回 huí 予 yŭ 測 cè 行 xíng CPU を100%の使 shĭ 用 yòng 率 lw 数 shù 分 fēn 間 jiān 占 zhān 有 yoŭ GPU 処 chŭ 理 lĭ 回 huí 予 yŭ 測 cè 数 shù 秒 miaŏ [ 6] 問 wèn 題 tí 軽 qīng 減 jiăn Hugging Face は、知 zhī 識 shì 蒸 zhēng 留 liú 使 shĭ 用 yòng 品 pĭn 質 zhí 数 shù 低 dī 小 xiaŏ 倍 beì 速 sù 小 xiaŏ 型 xíng 作 zuò 成 chéng 開 kaī 発 fā [ 6]

ジャーナリストによって報 baò 応 yīng 用 yòng 記 jì 事 shì 文 wén 章 zhāng 人 rén 間 jiān 書 shū 補 bŭ 助 zhù 挙 jŭ [ 7] 製 zhì 品 pĭn 版 băn 公 gōng 開 kaī 以 yĭ 前 qián 利 lì 用 yòng 年 nián 月 yuè Reddit サイト内 neì サブレディット )が作 zuò 訓 xùn 練 liàn 実 shí 例 lì インスタンス )が投 toú 稿 gaŏ 互 hù 返 făn 信 xìn 擬 nĭ 人 rén 化 huà 機 jī 械 xiè 学 xué 習 xí 由 yoú 来 laí 霊 líng 議 yì 論 lùn 状 zhuàng 況 kuàng 作 zuò [ 86] 同 tóng 年 nián 月 yuè 基 jī プログラミング言 yán 語 yŭ のコード行 xíng 自 zì 動 dòng 補 bŭ 完 wán 公 gōng 開 kaī 変 biàn 評 píng [ 87]

2019年 nián 利 lì 用 yòng 入 rù 力 lì 基 jī 動 dòng 的 de テキストアドベンチャー を提 tí 供 gōng AI Dungeon (英 yīng 語 yŭ 版 băn 発 fā 表 biaŏ [ 88] 年 nián 現 xiàn 在 zaì 有 yoŭ 料 liaò 最 zuì 大 dà 提 tí 供 gōng 無 wú 料 liaò 版 băn 番 fān 目 mù 大 dà 使 shĭ 用 yòng [ 89] 中 zhōng 心 xīn 設 shè 立 lì 年 nián 開 kaī 業 yè 資 zī 金 jīn (英 yīng 語 yŭ 版 băn 万 wàn 調 diaò 達 dá [ 90] 他 tā 対 duì 話 huà 的 de 公 gōng 開 kaī [ 91] [ 92] [ 93]

2021年 nián 月 yuè 問 wèn 題 tí 抱 baò 向 xiàng 危 weī 機 jī 管 guăn 理 lĭ 十 shí 代 daì 模 mó 擬 nĭ 患 huàn 者 zhě 会 huì 話 huà 由 yoú 来 laí 使 shĭ 用 yòng 始 shĭ 発 fā 表 biaŏ 使 shĭ 用 yòng 純 chún 粋 cuì 内 neì 部 bù 目 mù 的 de 自 zì 身 shēn 交 jiaō 信 xìn [ 94]

^ Piper, Kelsey (2019年 nián 月 yuè 日 rì A poetry-writing AI has just been unveiled. It's ... pretty good. ”. Vox 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ a b Johnson, Khari (2019年 nián 月 yuè 日 rì OpenAI releases curtailed version of GPT-2 language model ”. VentureBeat . 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b Vincent, James (2019年 nián 月 yuè 日 rì OpenAI has published the text-generating AI it said was too dangerous to share ”. The Verge 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b c “Better Language Models and Their Implications ”. OpenAI (2019年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b Hegde, Chaitra; Patil, Shrikumar (9 June 2020). "Unsupervised Paraphrase Generation using Pre-trained Language Models". arXiv :2006.05477 cs.CL ]。

^ a b c Kaiser, Caleb (2020年 nián 月 yuè 日 rì Too big to deploy: How GPT-2 is breaking servers ”. Towards Data Science . 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b c d e f Hern, Alex (2019年 nián 月 yuè 日 rì New AI fake text generator may be too dangerous to release, say creators ”. The Guardian 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b c d e f g Radford, Alec; Wu, Jeffrey; Child, Rewon; Luan, David; Amodei, Dario; Sutskever, Ilua (14 February 2019). Language models are unsupervised multitask learners 1 . オリジナル の6 February 2021時 shí 点 diăn . https://web.archive.org/web/20210206183945/https://cdn.openai.com/better-language-models/language_models_are_unsupervised_multitask_learners.pdf 2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn .

^ a b c d e f g h i j k l m n o p q r s “Improving Language Understanding by Generative Pre-Training ”. OpenAI . pp. 12 (2018年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b c d e f Polosukhin, Illia; Kaiser, Lukasz; Gomez, Aidan N.; Jones, Llion; Uszkoreit, Jakob; Parmar, Niki; Shazeer, Noam; Vaswani, Ashish (12 June 2017). "Attention Is All You Need". arXiv :1706.03762 cs.CL ]。

^ a b c d e Olah, Chris; Carter, Shan (8 September 2016). “Attention and Augmented Recurrent Neural Networks” . Distill 1 (9). doi :10.23915/distill.00001 . オリジナル の22 December 2020時 shí 点 diăn . https://web.archive.org/web/20201222104024/https://distill.pub/2016/augmented-rnns/ 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn .

^ a b c d e f Bahdanau, Dzmitry; Cho, Kyunghyun; Bengio, Yoshua (1 September 2014). "Neural Machine Translation by Jointly Learning to Align and Translate". arXiv :1409.0473 cs.CL ]。

^ a b c d e f g Luong, Minh-Thang; Pham, Hieu; Manning, Christopher D. (17 August 2015). "Effective Approaches to Attention-based Neural Machine Translation". arXiv :1508.04025 cs.CL ]。

^ a b “GPT-2: 1.5B Release ” (英 yīng 語 yŭ OpenAI (2019年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2019年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ Brown, Tom B.; Mann, Benjamin; Ryder, Nick; Subbiah, Melanie; Kaplan, Jared; Dhariwal, Prafulla; Neelakantan, Arvind; Shyam, Pranav; Sastry, Girish; Askell, Amanda; Agarwal, Sandhini; Herbert-Voss, Ariel; Krueger, Gretchen; Henighan, Tom; Child, Rewon; Ramesh, Aditya; Ziegler, Daniel M.; Wu, Jeffrey; Winter, Clemens; Hesse, Christopher; Chen, Mark; Sigler, Eric; Litwin, Mateusz; Gray, Scott; Chess, Benjamin; Clark, Jack; Berner, Christopher; McCandlish, Sam; Radford, Alec; Sutskever, Ilya; Amodei, Dario (22 July 2020). "Language Models are Few-Shot Learners". arXiv :2005.14165 cs.CL ]。 ^ Arram (2020年 nián 月 yuè 日 rì GPT-3: An AI that's eerily good at writing almost anything ”. Arram Sabeti . 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Hao, Karen (September 23, 2020). “OpenAI is giving Microsoft exclusive access to its GPT-3 language model” (英 yīng 語 yŭ MIT Technology Review . https://www.technologyreview.com/2020/09/23/1008729/openai-is-giving-microsoft-exclusive-access-to-its-gpt-3-language-model/ 2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn . ""The companies say OpenAI will continue to offer its public-facing API, which allows chosen users to send text to GPT-3 or OpenAI’s other models and receive its output. Only Microsoft, however, will have access to GPT-3’s underlying code, allowing it to embed, repurpose, and modify the model as it pleases."" ^ Turing, Alan (October 1950), "Computing Machinery and Intelligence", Mind LIX (236): 433–460, doi :10.1093/mind/LIX.236.433 , ISSN 0026-4423 。^ Samuel, Arthur (1959). “Some Studies in Machine Learning Using the Game of Checkers”. IBM Journal of Research and Development 3 (3): 210–229. doi :10.1147/rd.33.0210 . ^ a b c Hancox, P.J. (1996年 nián 月 yuè 日 rì SEM1A5 – Part 1 – A brief history of NLP ”. University of Birmingham. 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b Nye, Mary Jo (2016). “Speaking in Tongues: Science's centuries-long hunt for a common language” . Distillations 2 (1): 40–43. オリジナル の3 August 2020時 shí 点 diăn . https://web.archive.org/web/20200803130801/https://www.sciencehistory.org/distillations/magazine/speaking-in-tongues 2018年 nián 月 yuè 日 rì 閲 yuè 覧 lăn .

^ Gordin, Michael D. (2015). Scientific Babel: How Science Was Done Before and After Global English . Chicago, Illinois: University of Chicago Press. ISBN 9780226000299 ^ John Hutchins. The first public demonstration of machine translation: the Georgetown-IBM system, 7th January 1954 (PDF) (Report). S2CID 132677 。 ^ Reifler, Erwin (February 2–5, 1960). “The solution of MT linguistic problems through lexicography.”. Proceedings of the National Symposium on Machine Translation . ^ Hutchins, John (1997). “From first conception to first demonstration: the nascent years of machine translation, 1947–1954. A chronology.”. Machine Translation 12, 195–252 12 (3): 195–252. doi :10.1023/A:1007969630568 . ^ Winograd, Terry (1971-01-01) (英 yīng 語 yŭ Procedures as a Representation for Data in a Computer Program for Understanding Natural Language hdl :1721.1/7095 オリジナル の2021-01-13時 shí 点 diăn . https://web.archive.org/web/20210113121007/https://dspace.mit.edu/handle/1721.1/7095 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn . ^ “SHRDLU ”. Stanford Human-Computer Interaction (HCI) Group . 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Weizenbaum, Joseph (January 1966), “ELIZA – A Computer Program For the Study of Natural Language Communication Between Man And Machine”, Communications of the ACM 9 (1): 36–45, doi :10.1145/365153.365168 ^ Bassett, Caroline (2019). “The computational therapeutic: exploring Weizenbaum's ELIZA as a history of the present”. AI & Society 34 (4): 803–812. doi :10.1007/s00146-018-0825-9 . ^ Hancox, P.J. (1996年 nián 月 yuè 日 rì SEM1A5 – Part 1 – The state-of-the-art ”. University of Birmingham. 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Howe, J. (1994年 nián 月 yuè Artificial Intelligence at Edinburgh University : a Perspective ”. 2007年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2007年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ a b Russell, Stuart J. ; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach ISBN 0-13-790395-2 , オリジナル の2011-02-28時 shí 点 diăn , https://web.archive.org/web/20110228023805/http://aima.cs.berkeley.edu/ 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn , ""Overall, the AI industry boomed from a few million dollars in 1980 to billions of dollars in 1988. Soon after that came a period called the 'AI Winter'""

^

Rosenblatt, Frank (1957). “The Perceptron—a perceiving and recognizing automaton”. Report 85-460-1 (Cornell Aeronautical Laboratory).

^ Bishop, Christopher M. (2006). Pattern Recognition and Machine Learning . Springer. ISBN 0-387-31073-8 ^ a b Olazaran, Mikel (1996). “A Sociological Study of the Official History of the Perceptrons Controversy”. Social Studies of Science 26 (3): 611–659. doi :10.1177/030631296026003005 . JSTOR 285702 .

^ Minsky, Marvin; Papert, Seymour (1969), Perceptrons: An Introduction to Computational Geometry , MIT Press, ISBN 0-262-63022-2 ^ a b c d Wilson, Bill (2012年 nián 月 yuè 日 rì The Machine Learning Dictionary ”. www.cse.unsw.edu.au . 2018年 nián 月 yuè 日 rì 時 shí 点 diăn オリジナル よりアーカイブ。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b Goodfellow, Ian; Bengio, Yoshua; Courville, Aaron (2016). “6.5 Back-Propagation and Other Differentiation Algorithms” . Deep Learning . MIT Press. pp. 200–220. ISBN 9780262035613 . オリジナル の2018-01-27時 shí 点 diăn . https://web.archive.org/web/20180127104809/http://www.deeplearningbook.org/ 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ Werbos, Paul J. (1994). The Roots of Backpropagation : From Ordered Derivatives to Neural Networks and Political Forecasting . New York: John Wiley & Sons. ISBN 0-471-59897-6 ^ Crevier, Daniel [in 英 yīng 語 yŭ (1993), AI: The Tumultuous Search for Artificial Intelligence , New York, NY: BasicBooks, ISBN 0-465-02997-3 。^ Parker, D.B. (1985). Learning Logic . Cambridge MA: Massachusetts Institute of Technology. ^ Rumelhart, David E.; Hinton, Geoffrey E.; Williams, Ronald J. (1986a). “Learning representations by back-propagating errors”. Nature 323 (6088): 533–536. Bibcode : 1986Natur.323..533R . doi :10.1038/323533a0 . ^ Fukushima, Kunihiko「位 weì 置 zhì 影 yĭng 響 xiăng 認 rèn 識 shì 機 jī 構 goù 神 shén 経 jīng 回 huí 路 lù 第 dì 号 haò 年 nián 月 yuè 頁 yè オリジナル の2021年 nián 月 yuè 日 rì 時 shí 点 diăn 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn 。 ^ LeCun, Yann; Bengio, Yoshua; Hinton, Geoffrey (2015). “Deep learning”. Nature 521 (7553): 436–444. Bibcode : 2015Natur.521..436L . doi :10.1038/nature14539 . PMID 26017442 . ^ a b c d e Bajpai, Akash (2019年 nián 月 yuè 日 rì Recurrent Neural Networks: Deep Learning for NLP ”. Towards Data Science . 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ ゼップ・ホッフライター; ユルゲン・シュミットフーバー (1995年 nián 月 yuè 日 rì Long Short Term Memory , ftp://ftp.idsia.ch/pub/juergen/fki-207-95.ps.gz Wikidata Q98967430 ^ ゼップ・ホッフライター; ユルゲン・シュミットフーバー (1997年 nián “LSTM can Solve Hard Long Time Lag Problems” (英 yīng 語 yŭ Advances in Neural Information Processing Systems 9 , Advances in Neural Information Processing Systems, https://papers.nips.cc/paper/1215-lstm-can-solve-hard-long-time-lag-problems.pdf Wikidata Q77698282 ^ Sepp Hochreiter ; Jürgen Schmidhuber (1997). “Long short-term memory” . Neural Computation 9 (8): 1735–1780. doi :10.1162/neco.1997.9.8.1735 . PMID 9377276 . オリジナル の2021-01-22時 shí 点 diăn . https://web.archive.org/web/20210122144703/https://www.researchgate.net/publication/13853244_Long_Short-term_Memory 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn . ^ Graves, A.; Liwicki, M.; Fernández, S.; Bertolami, R.; Bunke, H.; Schmidhuber, J. (May 2009). “A Novel Connectionist System for Unconstrained Handwriting Recognition”. IEEE Transactions on Pattern Analysis and Machine Intelligence 31 (5): 855–868. doi :10.1109/tpami.2008.137 . ISSN 0162-8828 . PMID 19299860 . ^ Märgner, Volker; Abed, Haikal El (July 2009). “ICDAR 2009 Arabic Handwriting Recognition Competition”. 2009 10th International Conference on Document Analysis and Recognition : 1383–1387. doi :10.1109/ICDAR.2009.256 . ISBN 978-1-4244-4500-4 . ^ Olah, Chris (2015年 nián 月 yuè 日 rì Understanding LSTM Networks ”. 2017年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ “N-gram Counts and Language Models from the Common Crawl ”. pp. 3579–3584 (2014年 nián 月 yuè 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Wolf, Thomas; Debut, Lysandre; Sanh, Victor; Chaumond, Julien; Delangue, Clement; Moi, Anthony; Cistac, Pierric; Rault, Tim et al. (2020). “Transformers: State-of-the-Art Natural Language Processing”. Proceedings of the 2020 Conference on Empirical Methods in Natural Language Processing: System Demonstrations . pp. 38–45. doi :10.18653/v1/2020.emnlp-demos.6 ^ Zhu, Yukun; Kiros, Ryan; Zemel, Rich; Salakhutdinov, Ruslan; Urtasun, Raquel; Torralba, Antonio; Fidler, Sanja (2015). Aligning Books and Movies: Towards Story-Like Visual Explanations by Watching Movies and Reading Books arXiv :1506.06724 . https://www.cv-foundation.org/openaccess/content_iccv_2015/html/Zhu_Aligning_Books_and_ICCV_2015_paper.html . ^ a b "Our largest model, GPT-2, is a 1.5B parameter Transformer" Radford. (2019)

^ a b Tsvetkov, Yulia (2017年 nián 月 yuè 日 rì Opportunities and Challenges in Working with Low-Resource Languages ”. Carnegie Mellon University. 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ Zhu, Yukun; Kiros, Ryan; Zemel, Richard; Salakhutdinov, Ruslan; Urtasun, Raquel; Torralba, Antonio; Fidler, Sanja (22 June 2015). "Aligning Books and Movies: Towards Story-like Visual Explanations by Watching Movies and Reading Books". arXiv :1506.06724 cs.CV ]. # of books: 11,038 / # of sentences: 74,004,228 / # of words: 984,846,357 / mean # of words per sentence: 13 / median # of words per sentence: 11 ^ “A Broad-Coverage Challenge Corpus for Sentence Understanding through Inference ”. Association for Computational Linguistics (2018年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Lai, Guokun; Xie, Qizhe; Hanxiao, Liu; Yang, Yiming; Hovy, Eduard (15 April 2017). "RACE: Large-scale ReAding Comprehension Dataset From Examinations". arXiv :1704.04683 cs.CL ]。 ^ “LSDSem 2017 Shared Task: The Story Cloze Test ”. Association for Computational Linguistics (2017年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Wang, Alex; Singh, Amanpreet; Michael, Julian; Hill, Felix; Levy, Omar; Bowman, Samuel R. (20 April 2018). "GLUE: A Multi-Task Benchmark and Analysis Platform for Natural Language Understanding". arXiv :1804.07461 cs.CL ]。 ^ "a new dataset of millions of webpages called WebText ... which emphasizes document quality." Radford. (2019). Language Models are Unsupervised Multitask Learners .

^ "Our approach motivates building as large and diverse a dataset as possible in order to collect natural language demonstrations of tasks in as varied of domains and contexts as possible." Radford. (2019)

^ Trinh, Trieu H.; Le, Quoc V. (7 June 2018). "A Simple Method for Commonsense Reasoning". arXiv :1806.02847 cs.CL ]。 ^ "Common Crawl ... they have significant data quality issues ... We observed similar data issues in our initial experiments with Common Crawl." Radford. (2019)

^ "emphasizes document quality. To do this we only scraped web pages which have been curated/filtered by humans." Radford. (2019)

^ "we scraped all outbound links from Reddit, a social media platform, which received at least 3 karma." Radford. (2019)

^ 他 tā 多 duō 含 hán 過 guò 剰 shèng 適 shì 合 hé 原 yuán 因 yīn 可 kě 能 néng 性 xìng ^ "a preliminary version of WebText ... which ... contains slightly over 8 million documents for a total of 40 GB of text." Radford. (2019)

^ "Layer normalization ... was moved to the input of each sub-block" Radford. (2019)

^ "an additional layer normalization was added after the final self-attention block." Radford. (2019)

^ "A modified initialization which accounts for the accumulation on the residual path with model depth ... scale the weights of residual layers at initialization by a factor of 1/√N where N is the number of residual layers." Radford. (2019)

^ "The vocabulary is expanded to 50,257." Radford. (2019)

^ "We also increase the context size from 512 to 1024 tokens" Radford. (2019)

^ "a larger batchsize of 512 is used." Radford. (2019)

^ a b Quach, Katyanna (2019年 nián 月 yuè 日 rì Roses are red, this is sublime: We fed OpenAI's latest chat bot a classic Reg headline ”. The Register . 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b “The Staggering Cost of Training SOTA AI Models ”. Synced (2019年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ Wiggers, Kyle (2020年 nián 月 yuè 日 rì Google open-sources framework that reduces AI training costs by up to 80% ”. VentureBeat . 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ a b c d e f Vincent, James (2019年 nián 月 yuè 日 rì OpenAI's new multitalented AI writes, translates, and slanders ”. The Verge 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b c Piper, Kelsey (2019年 nián 月 yuè 日 rì An AI helped us write this article ”. Vox 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2020年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ Köbis, Nils; Mossink, Luca D. (1 January 2021). “Artificial intelligence versus Maya Angelou: Experimental evidence that people cannot differentiate AI-generated from human-written poetry”. Computers in Human Behavior 114 : 106553. doi :10.1016/j.chb.2020.106553 . ^ Schwartz, Oscar (2019年 nián 月 yuè 日 rì “Could 'fake text' be the next global political threat?” . The Guardian . オリジナル の2019年 nián 月 yuè 日 rì 時 shí 点 diăn . https://web.archive.org/web/20190716035703/https://www.theguardian.com/technology/2019/jul/04/ai-fake-text-gpt-2-concerns-false-information 2019年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ a b Vincent, James (2019年 nián 月 yuè 日 rì AI researchers debate the ethics of sharing potentially harmful programs ”. The Verge. 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ a b Zhang, Hugh (2019年 nián 月 yuè 日 rì OpenAI: Please Open Source Your Language Model ”. The Gradient. 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ “OpenGPT-2: We Replicated GPT-2 Because You Can Too ”. Noteworthy (2019年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ a b Vincent, James (2019年 nián 月 yuè 日 rì There's a subreddit populated entirely by AI personifications of other subreddits ”. The Verge . 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn

^ Vincent, James (2019年 nián 月 yuè 日 rì This AI-powered autocompletion software is Gmail's Smart Compose for coders ”. The Verge . 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Olson, Mathew (2019年 nián 月 yuè 日 rì AI Dungeon 2, the Text Adventure Where You Can do Nearly Anything, Is Now on Mobile ”. 2020年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Nelius, Joanna (2020年 nián 月 yuè 日 rì This AI-Powered Choose-Your-Own-Adventure Text Game Is Super Fun and Makes No Sense ”. Gizmodo . 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ Ha, Anthony (2021年 nián 月 yuè 日 rì AI Dungeon-maker Latitude raises $3.3M to build games with 'infinite' story possibilities ”. TechCrunch. 2021年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ “Write With Transformer ”. 2019年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ “Talk to Transformer ”. 2019年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ “CreativeEngines ”. 2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn ^ “An AI is training counselors to deal with teens in crisis ”. MIT Technology Review (2021年 nián 月 yuè 日 rì 年 nián 月 yuè 日 rì 時 shí 点 diăn アーカイブ 。2021年 nián 月 yuè 日 rì 閲 yuè 覧 lăn