異常 いじょう 検知 けんち 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 英 えい local outlier factor, LOF )は Markus M. Breunig、Hans-Peter Kriegel (英語 えいご 版 ばん 年 ねん 提案 ていあん 任意 にんい 点 てん 近傍 きんぼう 点 てん 対 たい 局所 きょくしょ 的 てき 変動 へんどう 測 はか 異常 いじょう 発見 はっけん [1]

局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 距離 きょり 到達 とうたつ 可能 かのう 性 せい 距離 きょり 等 とう 概念 がいねん DBSCAN やOPTICS (英語 えいご 版 ばん 共有 きょうゆう 局所 きょくしょ 密度 みつど 推定 すいてい 用 もち [2]

LOFの基本 きほん 的 てき 点 てん 局所 きょくしょ 密度 みつど 近傍 きんぼう 比較 ひかく 点 てん 近傍 きんぼう 比 くら 局所 きょくしょ 密度 みつど 小 ちい 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 局所 きょくしょ 密度 みつど 概念 がいねん 基 もと 局所 きょくしょ

k

{\displaystyle k}

個 こ 最 さい 近傍 きんぼう 与 あた 距離 きょり 密度 みつど 推定 すいてい 局所 きょくしょ 密度 みつど 近傍 きんぼう 群 ぐん 局所 きょくしょ 密度 みつど 比較 ひかく 密度 みつど 同 どう 程度 ていど 領域 りょういき 周囲 しゅうい 比 くら 密度 みつど 有意 ゆうい 低 ひく 点 てん 特定 とくてい 点 てん 外 はず 値 ち 考 かんが

局所 きょくしょ 密度 みつど 近傍 きんぼう 到達 とうたつ 標準 ひょうじゅん 的 てき 距離 きょり 使 つか 推定 すいてい 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 到達 とうたつ 可能 かのう 性 せい 距離 きょり 内 ない 安定 あんてい 的 てき 値 ね 生 しょう 追加 ついか 的 てき 定義 ていぎ 尺度 しゃくど

k-distance

(

A

)

{\displaystyle {\mbox{k-distance}}(A)}

A

{\displaystyle A}

k 番 ばん 目 め 近傍 きんぼう 距離 きょり k 個 こ 最 さい 近傍 きんぼう 距離 きょり 以下 いか 全 すべ 集合 しゅうごう 存在 そんざい 場合 ばあい 個数 こすう k より大 おお 得 え 注意 ちゅうい k 最近 さいきん 傍 はた 集合 しゅうごう

N

k

(

A

)

{\displaystyle N_{k}(A)}

書 か

到達 とうたつ 可能 かのう 性 せい 距離 きょり 図示 ずし B と C は等 ひと 到達 とうたつ 可能 かのう 性 せい 距離 きょり 持 も 一方 いっぽう D は k 最近 さいきん 傍 はた この距離 きょり 到達 とうたつ 可能 かのう 性 せい 距離 きょり 呼 よ 値 ね 定義 ていぎ 用 もち

reachability-distance

k

(

A

,

B

)

=

max

{

k-distance

(

B

)

,

d

(

A

,

B

)

}

{\displaystyle {\mbox{reachability-distance}}_{k}(A,B)=\max\{{\mbox{k-distance}}(B),d(A,B)\}}

つまり、オブジェクト

A

{\displaystyle A}

B

{\displaystyle B}

到達 とうたつ 可能 かのう 性 せい 距離 きょり

B

{\displaystyle B}

k-distance

{\displaystyle {\mbox{k-distance}}}

以上 いじょう 限 かぎ 間 あいだ 真 しん 距離 きょり 一致 いっち

B

{\displaystyle B}

k 最近 さいきん 傍 はた 集合 しゅうごう

B

{\displaystyle B}

DBSCANクラスタ解析 かいせき を参照 さんしょう 全 すべ 等距離 とうきょり 見 み 距離 きょり 考 かんが 結果 けっか 安定 あんてい 的 てき 対称 たいしょう 的 てき 数学 すうがく 的 てき 定義 ていぎ 上 じょう 距離 きょり 注意 ちゅうい 常 つね

k-distance

{\displaystyle {\mbox{k-distance}}}

方 ほう 使 つか 誤 あやま [3] 場合 ばあい 呼 よ 異 こと 手法 しゅほう [3]

オブジェクト

A

{\displaystyle A}

局所 きょくしょ 到達 とうたつ 可能 かのう 性 せい 密度 みつど

lrd

k

(

A

)

:=

1

/

(

∑

B

∈

N

k

(

A

)

reachability-distance

k

(

A

,

B

)

|

N

k

(

A

)

|

)

{\displaystyle {\mbox{lrd}}_{k}(A):=1/\left({\frac {\sum _{B\in N_{k}(A)}{\mbox{reachability-distance}}_{k}(A,B)}{|N_{k}(A)|}}\right)}

と定義 ていぎ

A

{\displaystyle A}

近傍 きんぼう 群 ぐん 到達 とうたつ 可能 かのう 性 せい 距離 きょり 平均 へいきん 逆数 ぎゃくすう

A

{\displaystyle A}

近傍 きんぼう 到達 とうたつ 距離 きょり 平均 へいきん 定義 ていぎ 上 じょう

k-distance

(

A

)

{\displaystyle {\mbox{k-distance}}(A)}

等 ひと 近傍 きんぼう

A

{\displaystyle A}

到達 とうたつ 距離 きょり 平均 へいきん 注意 ちゅうい 重 かさ 点 てん 値 ね 無限 むげん 大 だい 得 え

次 つぎ 以下 いか 近傍 きんぼう 群 ぐん 局所 きょくしょ 到達 とうたつ 可能 かのう 性 せい 密度 みつど 比較 ひかく

LOF

k

(

A

)

:=

∑

B

∈

N

k

(

A

)

lrd

(

B

)

lrd

(

A

)

|

N

k

(

A

)

|

=

∑

B

∈

N

k

(

A

)

lrd

(

B

)

|

N

k

(

A

)

|

/

lrd

(

A

)

{\displaystyle {\mbox{LOF}}_{k}(A):={\frac {\sum _{B\in N_{k}(A)}{\frac {{\mbox{lrd}}(B)}{{\mbox{lrd}}(A)}}}{|N_{k}(A)|}}={\frac {\sum _{B\in N_{k}(A)}{\mbox{lrd}}(B)}{|N_{k}(A)|}}/{\mbox{lrd}}(A)}

これは「近傍 きんぼう 群 ぐん 局所 きょくしょ 到達 とうたつ 可能 かのう 性 せい 密度 みつど 平均 へいきん 自身 じしん 局所 きょくしょ 到達 とうたつ 可能 かのう 性 せい 密度 みつど 割 わ

1

{\displaystyle 1}

近 ちか 値 ね 近傍 きんぼう 同 どう 程度 ていど 外 はず 値 ち

1

{\displaystyle 1}

下回 したまわ 点 てん 密度 みつど 高 たか 領域 りょういき 内部 ないぶ 点 てん 位置 いち

1

{\displaystyle 1}

有意 ゆうい 上回 うわまわ 外 はず 値 ち

LOF(k) ~ 1 は、近傍 きんぼう 同 どう 程度 ていど 密度 みつど 意味 いみ

LOF(k) < 1 は、近傍 きんぼう 高密度 こうみつど 意味 いみ

LOF(k) > 1 は、近傍 きんぼう 低 てい 密度 みつど 意味 いみ

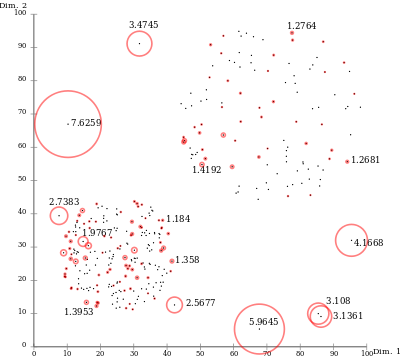

ELKI (英語 えいご 版 ばん 可視 かし 化 か 上方 かみがた 右側 みぎがわ 内 ない 局所 きょくしょ 密度 みつど 下方 かほう 左側 ひだりがわ 近接 きんせつ 外 はず 値 ち 局所 きょくしょ 密度 みつど 同 どう 程度 ていど 外 はず 値 ち 正 まさ 検知 けんち 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 局所 きょくしょ 的 てき 別 べつ 領域 りょういき 位置 いち 外 はず 値 ち 点 てん 外 はず 値 ち 検知 けんち 例 たと 密度 みつど 高 たか 距離 きょり 小 ちい 点 てん 内 ない 点 てん 近傍 きんぼう 距離 きょり 同 どう 程度 ていど 外 はず 値 ち

局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 幾何 きか 学 がく 的 てき 直観 ちょっかん 捉 とら 低 てい 次元 じげん 空間 くうかん 場合 ばあい 限 かぎ 非 ひ 類似 るいじ 度 ど 関数 かんすう 定義 ていぎ 任意 にんい 状況 じょうきょう 対 たい 適用 てきよう 手法 しゅほう 経験 けいけん 的 てき 数 すう 多 おお 設定 せってい 下 か 非常 ひじょう 上手 うま 働 はたら 示 しめ 例 たと 侵入 しんにゅう 検知 けんち [4] 加工 かこう 分類 ぶんるい [5] 関 かん 競合 きょうごう 手法 しゅほう 優 すぐ 結果 けっか 出 だ

局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 類似 るいじ 手法 しゅほう 群 ぐん 他 た 様々 さまざま 問題 もんだい 例 たと 地理 ちり 動画 どうが 著者 ちょしゃ 外 はず 値 ち 検知 けんち 対 たい 容易 ようい 一般 いっぱん 化 か [3]

出力 しゅつりょく 値 ち 分数 ぶんすう 解釈 かいしゃく 難 むずか 値 ね 以下 いか 明確 めいかく 外 はず 値 ち 判断 はんだん 外 はず 値 ち 対 たい 明確 めいかく 規則 きそく 存在 そんざい 値 ね 外 はず 値 ち 一方 いっぽう 別 べつ 別 べつ 局所 きょくしょ 的 てき 変動 へんどう 激 はげ 下 した 値 ね 外 はず 値 ち 手法 しゅほう 局所 きょくしょ 性 せい 相違 そうい 一 ひと 中 なか 発生 はっせい 得 え 特質 とくしつ 改善 かいぜん 試 こころ 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 拡張 かくちょう 存在 そんざい

Feature Bagging for Outlier Detection (外 はず 値 ち 対 たい 特徴 とくちょう [6] 複数 ふくすう 射影 しゃえい 対 たい 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 実行 じっこう 結果 けっか 結合 けつごう 高 こう 次元 じげん 検知 けんち 質 しつ 高 たか 異常 いじょう 検知 けんち 対 たい アンサンブル学習 がくしゅう アプローチの最初 さいしょ 例 れい 他 た 変種 へんしゅ 脚注 きゃくちゅう [7] 参照 さんしょう Local Outlier Probability (LoOP)[8] 局所 きょくしょ 外 はず 値 ち 確 かく 率 りつ 局所 きょくしょ 外 はず 値 ち 因子 いんし 法 ほう 派生 はせい 手法 しゅほう 込 こ 入 い 局所 きょくしょ 的 てき 統計 とうけい 量 りょう 用 もち 結果 けっか k の選択 せんたく 鋭敏 えいびん 左右 さゆう 出力 しゅつりょく 値 ち

[

0

:

1

]

{\displaystyle [0:1]}

区間 くかん 値 ね 規格 きかく 化 か Interpreting and Unifying Outlier Scores [9] 外 はず 値 ち 解釈 かいしゃく 統合 とうごう ユーザビリティ 向上 こうじょう 統計 とうけい 的 てき 用 もち 外 はず 値 ち 区間 くかん

[

0

:

1

]

{\displaystyle [0:1]}

値 ね 規格 きかく 化 か 提案 ていあん 改善 かいぜん 案 あん On Evaluation of Outlier Rankings and Outlier Scores [10] 外 はず 値 ち 外 はず 値 ち 評価 ひょうか 変種 へんしゅ 別 べつ 用 もち 高度 こうど 異常 いじょう 検知 けんち 構築 こうちく 法 ほう 同士 どうし 類似 るいじ 度 ど 相違 そうい 度 ど 測 はか 手法 しゅほう 提案 ていあん 上述 じょうじゅつ Feature Bagging for Outlier Detection を改善 かいぜん Local outlier detection reconsidered: a generalized view on locality with applications to spatial, video, and network outlier detection [3] 局所 きょくしょ 外 はず 値 ち 検知 けんち 再考 さいこう 空間 くうかん 映像 えいぞう 外 はず 値 ち 検知 けんち 用 もち 局所 きょくしょ 性 せい 一般 いっぱん 的 てき 視点 してん 様々 さまざま 局所 きょくしょ 外 はず 値 ち 検知 けんち 手法 しゅほう 例 たと 一般 いっぱん 的 てき 議論 ぎろん 一般 いっぱん 的 てき 抽象 ちゅうしょう 続 つづ 地理 ちり 動画 どうが 著者 ちょしゃ 等 とう 外 はず 値 ち 検知 けんち 応用 おうよう

^ Breunig, M. M.; Kriegel, H.-P. ; Ng, R. T.; Sander, J. (2000). LOF: Identifying Density-based Local Outliers (PDF) . Proceedings of the 2000 ACM SIGMOD International Conference on Management of Data . SIGMOD . pp. 93–104. doi :10.1145/335191.335388 . ISBN 1-58113-217-4 ^ Breunig, M. M.; Kriegel, H.-P. ; Ng, R. T.; Sander, J. R. (1999). “OPTICS-OF: Identifying Local Outliers” . Principles of Data Mining and Knowledge Discovery . Lecture Notes in Computer Science. 1704 . pp. 262. doi :10.1007/978-3-540-48247-5_28 . ISBN 978-3-540-66490-1 . http://www.dbs.ifi.lmu.de/Publikationen/Papers/PKDD99-Outlier.pdf ^ a b c d Schubert, E.; Zimek, A.; Kriegel, H. -P. (2012). “Local outlier detection reconsidered: A generalized view on locality with applications to spatial, video, and network outlier detection”. Data Mining and Knowledge Discovery . doi :10.1007/s10618-012-0300-z .

^ Lazarevic, A.; Ozgur, A.; Ertoz, L.; Srivastava, J.; Kumar, V.; (2003). “A comparative study of anomaly detection schemes in network intrusion detection” . Proc. 3rd SIAM International Conference on Data Mining : 25–36. http://www.siam.org/proceedings/datamining/2003/dm03_03LazarevicA.pdf . ^ Campos, Guilherme O.; Zimek, Arthur; Sander, Jörg; Campello, Ricardo J. G. B.; Micenková, Barbora; Schubert, Erich; Assent, Ira; Houle, Michael E. (2016). “On the evaluation of unsupervised outlier detection: measures, datasets, and an empirical study”. Data Mining and Knowledge Discovery . doi :10.1007/s10618-015-0444-8 . ISSN 1384-5810 . ^ Lazarevic, A.; Kumar, V. (2005). “Feature bagging for outlier detection”. Proc. 11th ACM SIGKDD international conference on Knowledge Discovery in Data Mining : 157–166. doi :10.1145/1081870.1081891 . ^ Zimek, A.; Campello, R. J. G. B.; Sander, J. R. (2014). “Ensembles for unsupervised outlier detection”. ACM SIGKDD Explorations Newsletter 15 : 11. doi :10.1145/2594473.2594476 . ^ Kriegel, H.-P. ; Kröger, P.; Schubert, E.; Zimek, A. (2009). LoOP: Local Outlier Probabilities (PDF) . Proceedings of the 18th ACM conference on Information and knowledge management . CIKM '09. pp. 1649–1652. doi :10.1145/1645953.1646195 . ISBN 978-1-60558-512-3 ^ Kriegel, H. P. ; Kröger, P.; Schubert, E.; Zimek, A. (2011). Interpreting and Unifying Outlier Scores (PDF) . Proceedings of the 2011 SIAM International Conference on Data Mining. pp. 13–24. doi :10.1137/1.9781611972818.2 . ISBN 978-0-89871-992-5 ^ Schubert, E.; Wojdanowski, R.; Zimek, A.; Kriegel, H. P. (2012). On Evaluation of Outlier Rankings and Outlier Scores (PDF) . Proceedings of the 2012 SIAM International Conference on Data Mining. pp. 1047–1058. CiteSeerX 10.1.1.300.7205 doi :10.1137/1.9781611972825.90 . ISBN 978-1-61197-232-0

![{\displaystyle [0:1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3f30faa7e3ad864ab29a5b3635bd3afaff234c82)