次元 削減

データマイニング |

|---|

|

|

|

特徴 選択

[特徴 抽出

[主成分 分析

[非負 値 行列 因子 分解 (NMF)

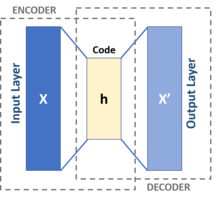

[オートエンコーダ

[

オートエンコーダは、

t-SNE

[t

脚注

[注釈

[- ^ むろんデータは

失 われるものの、最 も重要 な分散 が保持 されることを期待 している。

出典

[- ^ Postma, Eric; van den Herik, Jaap; van der Lubbe, Jan (2007-04). “Paintings and writings in the hands of scientists”. Pattern Recognition Letters 28 (6): 671–672. doi:10.1016/j.patrec.2006.08.006. ISSN 0167-8655.

- ^ Pudil, Pavel; Novovičová, Jana (1998), Novel Methods for Feature Subset Selection with Respect to Problem Knowledge, Springer US, pp. 101–116, ISBN 978-1-4613-7622-4 2022

年 1月 23日 閲覧 。 - ^ Rico-Sulayes, Antonio (2017). “Reducing Vector Space Dimensionality in Automatic Classification for Authorship Attribution”. Revista Ingeniería Electrónica, Automática y Comunicaciones 38 (3): 26–35. ISSN 1815-5928.

- ^ Samet, H. (2006) Foundations of Multidimensional and Metric Data Structures. Morgan Kaufmann. ISBN 0-12-369446-9

- ^ C. Ding, X. He, H. Zha, H.D. Simon, Adaptive Dimension Reduction for Clustering High Dimensional Data, Proceedings of International Conference on Data Mining, 2002

- ^ Lu, Haiping; Plataniotis, K.N.; Venetsanopoulos, A.N. (2011). “A Survey of Multilinear Subspace Learning for Tensor Data”. Pattern Recognition 44 (7): 1540–1551. doi:10.1016/j.patcog.2011.01.004.

- ^ a b Blanton, Michael R.; Roweis, Sam (2007). “K-corrections and filter transformations in the ultraviolet, optical, and near infrared”. The Astronomical Journal 133 (2): 734–754. arXiv:astro-ph/0606170. Bibcode: 2007AJ....133..734B. doi:10.1086/510127.

- ^ a b Ren, Bin; Pueyo, Laurent; Zhu, Guangtun B.; Duchêne, Gaspard (2018). “Non-negative Matrix Factorization: Robust Extraction of Extended Structures”. The Astrophysical Journal 852 (2): 104. arXiv:1712.10317. Bibcode: 2018ApJ...852..104R. doi:10.3847/1538-4357/aaa1f2.

- ^ a b Daniel D. Lee & H. Sebastian Seung (1999). “Learning the parts of objects by non-negative matrix factorization”. Nature 401 (6755): 788–791. Bibcode: 1999Natur.401..788L. doi:10.1038/44565. PMID 10548103.

- ^ Daniel D. Lee & H. Sebastian Seung (2001). Algorithms for Non-negative Matrix Factorization (PDF). Advances in Neural Information Processing Systems 13: Proceedings of the 2000 Conference. MIT Press. pp. 556–562.

- ^ a b

武彦 ,安川 「非負 値 行列 因子 分解 を用 いたテキストデータ解析 」『計算 機 統計 学 』第 28巻 第 1号 、2015年 、42頁 、doi:10.20551/jscswabun.28.1_41。 - ^ a b Zhu, Guangtun B. (19 December 2016). "Nonnegative Matrix Factorization (NMF) with Heteroscedastic Uncertainties and Missing data". arXiv:1612.06037 [astro-ph.IM]。

- ^ Ren, Bin; Pueyo, Laurent; Chen, Christine; Choquet, Elodie; Debes, John H.; Duechene, Gaspard; Menard, Francois; Perrin, Marshall D. (2020). “Using Data Imputation for Signal Separation in High Contrast Imaging”. The Astrophysical Journal 892 (2): 74. arXiv:2001.00563. Bibcode: 2020ApJ...892...74R. doi:10.3847/1538-4357/ab7024.

- ^

範 泰 ,尾 亦 「オートエンコーダによる低 次元 化 と可視 化 」『可視 化 情報 学会 誌 』第 38巻 第 151号 、2018年 、10頁 、doi:10.3154/jvs.38.151_9。 - ^ Schubert, Erich; Gertz, Michael (2017). Beecks, Christian; Borutta, Felix; Kröger, Peer et al.. eds. “Intrinsic t-Stochastic Neighbor Embedding for Visualization and Outlier Detection” (

英語 ). Similarity Search and Applications. Lecture Notes in Computer Science (Cham: Springer International Publishing) 10609: 188–203. doi:10.1007/978-3-319-68474-1_13. ISBN 978-3-319-68474-1.