强化 きょうか 学 がく 英語 えいご Reinforcement learning ,簡稱RL )是 これ 机 つくえ 器 き 学 がく 中 なか 的 てき 一 いち 域 いき 强 つよ 何 なん 基 き 环境 而行动,以取得 しゅとく 最大 さいだい 化 か 的 てき 利益 りえき [ 1] 强化 きょうか 学 がく 除 じょ 了 りょう 监督学 がく 和 わ 非 ひ 学 がく 之 これ 外的 がいてき 第 だい 与 あずか 学 がく 不同 ふどう 的 てき 是 ぜ 强化 きょうか 学 がく 需要 じゅよう 同 どう 最 さい 的 てき 精 せい 注 ちゅう 点在 てんざい 探索 たんさく 未知 みち 的 てき 和 かず 利用 りよう 有 ゆう 知 ち 的 てき 平衡 へいこう [ 2] 强化 きょうか 学 がく 的 てき 探索 たんさく 利用 りよう 的 てき 在 ざい 多 た 臂 ひじ 老 ろう 虎 とら 机 つくえ 和 わ 有限 ゆうげん 中 ちゅう 研究 けんきゅう 得 とく 最多 さいた

其灵感 かん 来 らい 源 げん 理学 りがく 中 ちゅう 的 てき 行 くだり 理 り 即 そく 有 ゆう 机 つくえ 体 たい 如何 いか 在 ざい 的 てき 或 ある 的 てき 刺激 しげき 下 か 形成 けいせい 刺激 しげき 的 てき 能 のう 最大 さいだい 利益 りえき 的 てき 性行 せいこう 方法 ほうほう 具有 ぐゆう 普 ふ 因 いん 都 と 有 ゆう 研究 けんきゅう 例 れい 博 ひろし 控 ひかえ 制 せい 运筹学 がく 、信 しん 息 いき 多 た 智能 ちのう 体系 たいけい 群 ぐん 体 たい 智能 ちのう 统计学 がく 以及遗传算法 さんぽう 。在 ざい 学 がく 和 わ 控 ひかえ 制 せい 理 り 研究 けんきゅう 的 てき 下 か 强化 きょうか 学 がく 称 しょう 作 さく 近似 きんじ 在 ざい 最 さい 制 せい 理 り 也有 やゆう 研究 けんきゅう 大 だい 部分 ぶぶん 的 てき 研究 けんきゅう 是 ぜ 最 さい 的 てき 存在 そんざい 和 わ 特性 とくせい 是 ぜ 学 がく 者 しゃ 近似 きんじ 方面 ほうめん 在 ざい 经济学 がく 和 わ 博 ひろし 中 なか 强化 きょうか 学 がく 用 よう 来 らい 解 かい 有限 ゆうげん 理性 りせい 的 てき 条件下 じょうけんか 如何 いか 出 で 平衡 へいこう

在 ざい 机 つくえ 器 き 学 がく 通常 つうじょう 被 ひ 抽象 ちゅうしょう 马尔可 か 夫 おっと (Markov decision processes,MDP),因 いん 多 た 强化 きょうか 学 がく 法 ほう 在 ざい 假 かり 才能 さいのう 使用 しよう 动态规划 的 てき 方法 ほうほう [ 3] 的 てき 方法 ほうほう 和 わ 强化 きょうか 学 がく 法的 ほうてき 主要 しゅよう 区 く 后 きさき 者 しゃ 不 ふ 需要 じゅよう 的 てき 知 ち 方法 ほうほう 的 てき 大 だい [ 4]

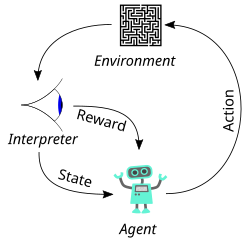

强化 きょうか 学 がく 典型 てんけい 框 かまち 架 か 智能 ちのう 体 たい 在 ざい 中 ちゅう 采 さい 取 と 一 いち 将 はた 随 ずい 后 きさき 反 はん 智能 ちのう 体 たい 由 よし 通用 つうよう 性 せい 强化 きょうか 学 がく 博 ひろし 控 ひかえ 制 せい 运筹学 がく 、信 しん 息 いき 仿真优化 、多 た 智能 ちのう 体 たい 群 ぐん 体 たい 智能 ちのう 和 わ 统计学 がく 等 とう 有 ゆう 了 りょう 深入 ふかいり 研究 けんきゅう 在 ざい 学 がく 和 わ 控 ひかえ 制 せい 文献 ぶんけん 中 ちゅう 强化 きょうか 学 がく 称 しょう 近似 きんじ 或 ある 神 かみ 强化 きょうか 学 がく 感 かん 的 てき 在 ざい 最 さい 制 せい 表示 ひょうじ 和 かず 求 もとむ 解 かい 的 てき 理 り 但 ただし 涉 わたる 近似 きんじ 中 なか 也有 やゆう 所 しょ 研究 けんきゅう 尤 ゆう 的 てき 数学 すうがく 模型 もけい 求 もとめ 得 とく 的 てき 在 ざい 学 がく 和博 かずひろ 中 ちゅう 强化 きょうか 学 がく 可能 かのう 被 ひ 用 もちい 来 らい 解 かい 有限 ゆうげん 的 てき 理性 りせい rationality )下 しも 如何 いか 平衡 へいこう 状 じょう

基本 きほん 的 てき 强化 きょうか 学 がく 建 けん 模 も 夫 おっと

环境状 じょう 集合 しゅうごう

S

{\displaystyle S}

动作的 てき 集合 しゅうごう

A

{\displaystyle A}

在 ざい 状 じょう 概 がい 率 りつ 矩 のり

P

{\displaystyle P}

规定转换后 きさき 即 そく 的 てき 函数 かんすう

R

{\displaystyle R}

描述主体 しゅたい 能 のう 的 てき 规则通常 つうじょう 是 ぜ 随 ずい 机 つくえ 的 てき 主体 しゅたい 通常 つうじょう 可 か 最 さい 后 きさき 一 いち 次 じ 在 ざい 模型 もけい 中 ちゅう 主体 しゅたい 被 ひ 假 かり 可 か 有 ゆう 的 てき 状 じょう 情 じょう 完全 かんぜん 可 か 反 はん 之 これ 部分 ぶぶん 可 か 通常 つうじょう 主体 しゅたい 被 ひ 允 まこと 是 ぜ 有限 ゆうげん 的 てき 例 れい 在 ざい 中 ちゅう 只 ただ 能 のう 上 じょう 下 した 左 ひだり 右 みぎ 移動 いどう 或 ある 是 ぜ 使用 しよう 的 てき 不能 ふのう 多 た 的 てき

强化 きょうか 学 がく 主体 しゅたい 与 あずか 基 もと 的 てき 步 ふ 作用 さよう 在 ざい 每 まい 一 いち

t

{\displaystyle t}

主体 しゅたい 接收 せっしゅう 到 いた 一 いち

o

t

{\displaystyle o_{t}}

通常 つうじょう 包含 ほうがん

r

t

{\displaystyle r_{t}}

然 しか 后 きさき 允 まこと 集合 しゅうごう 中 ちゅう 一 いち 作 さく

a

t

{\displaystyle a_{t}}

然 しか 后 きさき 送出 そうしゅつ 到 いた 中 ちゅう 去 さ 化 か 到 いた

s

t

+

1

{\displaystyle s_{t+1}}

然 しか 后 きさき 了 りょう 和 わ

(

s

t

,

a

t

,

s

t

+

1

)

{\displaystyle (s_{t},a_{t},s_{t+1})}

相 あい 的 てき

r

t

+

1

{\displaystyle r_{t+1}}

强化 きょうか 学 がく 主体 しゅたい 的 てき 目 め 是 ぜ 得 え 到 いた 尽 つき 可能 かのう 多 た 的 てき 主体 しゅたい 的 てき 是 ぜ 史 し 的 てき 函数 かんすう 可 か 机 つくえ 的 てき

将 はた 主体 しゅたい 的 てき 表 ひょう 自 じ 始 はじめ 自 じ 最 さい 式 しき 行 ぎょう 主体 しゅたい 相 しょう 比 ひ 之 の 行 ぎょう 生 せい 了 りょう 的 てき 概念 がいねん 要 よう 接近 せっきん 最 さい 方案 ほうあん 来 らい 行 ぎょう 主体 しゅたい 根 ね 据 すえ 序列 じょれつ 推理 すいり 例 れい 要 よう 最大 さいだい 化 か 我 が 的 てき 未来 みらい 收入 しゅうにゅう 我 わが 最 さい 好 こう 去 さ 上 うえ 学 がく 行 ぎょう 即 そく

因 いん 强化 きょうか 学 がく 期 き 反 はん 比 ひ 短期 たんき 反 はん 表 ひょう 好 このみ 上 じょう 得 え 到 いた 包括 ほうかつ 机 つくえ 器 き 人 じん 控 ひかえ 制 せい 电信 通 つう 双 そう 和 わ 西洋 せいよう 跳 とべ [ 5]

强化 きょうか 学 がく 强大 きょうだい 能力 のうりょく 来 らい 源 げん 面 めん 使用 しよう 本来 ほんらい 行 ぎょう 使用 しよう 函数 かんすう 近似 きんじ 来 らい 的 てき 使 し 得 とく 强化 きょうか 学 がく 使用 しよう 在 ざい 以下 いか 的 てき 中 ちゅう

模型 もけい 的 てき 已 やめ 知 ち 解析 かいせき 解 かい 不 ふ 存在 そんざい 仅仅给出环境的 てき 模 も 型 がた 模 かたぎ 化 か 方法 ほうほう 的 てき [ 6]

从环境 さかい 中 ちゅう 信 しん 息 いき 的 てき 唯 ただ 前 ぜん 可 か 考 こう 后 きさき 使用 しよう 强化 きょうか 学 がく 方法 ほうほう 可 か 机 つくえ 器 き 学 がく 蒙 こうむ 特 とく 学 がく Temporal-Difference Learning

SARSA算法 さんぽう Q学 がく 强化 きょうか 学 がく 需要 じゅよう 比 ひ 明 あかり 的 てき 探索 たんさく 机 つくえ 制 せい 直接 ちょくせつ 随 ずい 机 つくえ 的 てき 作 さく 采 さい 方法 ほうほう 性能 せいのう 比 ひ 小 しょう 的 てき 马氏过程 已 やめ 的 てき 比 ひ 楚 すわえ 性 せい 状 じょう 模 も 比 ひ 的 てき 相 しょう 探索 たんさく 机 つくえ 制 せい 是 ぜ 更 さら 加 か 的 てき

其中的 てき 一 いち 法 ほう

ϵ

{\displaystyle \epsilon }

貪婪 どんらん 演算 えんざん 法 ほう 方法 ほうほう 会 かい 的 てき 概 がい 率 りつ

ϵ

{\displaystyle \epsilon }

去 さ 最 さい 好 このみ 的 てき 没 ぼつ 有 ゆう 最 さい 作 さく 剩 あま 下 した 的 てき 中 ちゅう 随 ずい 机 つくえ 一 いち

ϵ

{\displaystyle \epsilon }

在 ざい 是 ぜ 更 さら 小 しょう 的 てき

ϵ

{\displaystyle \epsilon }

意味 いみ 着 ぎ 算法 さんぽう 会 かい 更 さら 加 か [ 7]

^ Hu, J.; Niu, H.; Carrasco, J.; Lennox, B.; Arvin, F. Voronoi-Based Multi-Robot Autonomous Exploration in Unknown Environments via Deep Reinforcement Learning . IEEE Transactions on Vehicular Technology. 2020, 69 (12): 14413-14423 [2021-03-21 ] . (原始 げんし 内容 ないよう 存 そん ^ Kaelbling, Leslie P. ; Littman, Michael L. ; Moore, Andrew W. Reinforcement Learning: A Survey . Journal of Artificial Intelligence Research. 1996, 4 : 237–285. S2CID 1708582 arXiv:cs/9605103 doi:10.1613/jair.301 原始 げんし 内容 ないよう 存 そん ^ van Otterlo, M.; Wiering, M. Reinforcement Learning and Markov Decision Processes. Reinforcement Learning. Adaptation, Learning, and Optimization 12 . 2012: 3–42. ISBN 978-3-642-27644-6doi:10.1007/978-3-642-27645-3_1 ^ 强化 きょうか 学 がく 原理 げんり 与 あずか 北京 ぺきん ISBN 9787111631774 ^ Sutton1998|Sutton and Barto 1998 Chapter 11

^ Gosavi, Abhijit . Simulation-based Optimization: Parametric Optimization Techniques and Reinforcement . Springer. 2003 [2015-08-19 ] . ISBN 1-4020-7454-9原始 げんし 内容 ないよう 存 そん ^ Tokic, Michel; Palm, Günther, Value-Difference Based Exploration: Adaptive Control Between Epsilon-Greedy and Softmax, KI 2011: Advances in Artificial Intelligence (PDF) , Lecture Notes in Computer Science 7006 , Springer: 335–346, 2011 [2018-09-03 ] , ISBN 978-3-642-24455-1原始 げんし 内容 ないよう 存 そん (PDF) 于2018-11-23)

基本 きほん 概念 がいねん 數學 すうがく 模型 もけい 學習 がくしゅう 範式 はんしき 主要 しゅよう 應用 おうよう 相關 そうかん 領域 りょういき

. doi:10.1613/jair.301. (

. doi:10.1613/jair.301. (