マルコフ決定 けってい 過程 かてい (マルコフけっていかてい、英 えい Markov decision process; MDP )は、状態 じょうたい 遷移 せんい 確 かく 率 りつ 的 てき 生 しょう 動的 どうてき 確 かく 率 りつ 確 かく 率 りつ 状態 じょうたい 遷移 せんい マルコフ性 せい を満 み 不 ふ 確実 かくじつ 性 せい 伴 ともな 意思 いし 決定 けってい 数学 すうがく 的 てき 枠組 わくぐ 強化 きょうか 学習 がくしゅう 動的 どうてき 計画 けいかく 法 ほう 適用 てきよう 幅広 はばひろ 最適 さいてき 化 か 問題 もんだい 研究 けんきゅう 活用 かつよう 少 すく 年代 ねんだい 知 し 研究 けんきゅう 中核 ちゅうかく 年 ねん 出版 しゅっぱん 起因 きいん ロボット工学 こうがく や自動 じどう 制御 せいぎょ 経済 けいざい 学 がく 製造 せいぞう 業 ぎょう 含 ふく 幅広 はばひろ 分野 ぶんや 用 もち

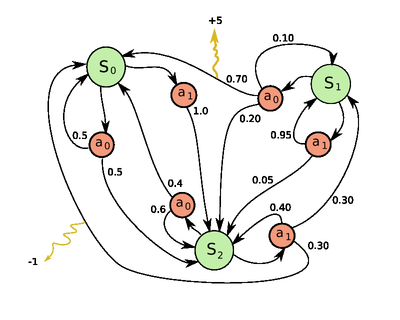

3つの状態 じょうたい 行動 こうどう 簡単 かんたん 例 れい マルコフ決定 けってい 過程 かてい 離散 りさん 時間 じかん 確 かく 率 りつ 制御 せいぎょ 過程 かてい 各 かく 時刻 じこく 過程 かてい 状態 じょうたい 取 と 意思 いし 決定 けってい 者 しゃ 状態 じょうたい 利用 りよう 可能 かのう 行動 こうどう 任意 にんい 選択 せんたく 後 ご 過程 かてい 新 あたら 状態 じょうたい 遷移 せんい 際 さい 意思 いし 決定 けってい 者 しゃ 状態 じょうたい 遷移 せんい 対応 たいおう 報酬 ほうしゅう 受 う

遷移 せんい 後 ご 状態 じょうたい

s

′

{\displaystyle s'}

得 え 報酬 ほうしゅう 値 ね

r

{\displaystyle r}

現在 げんざい 状態 じょうたい

s

{\displaystyle s}

行動 こうどう

a

{\displaystyle a}

依存 いぞん

s

{\displaystyle s}

a

{\displaystyle a}

与 あた 過去 かこ 状態 じょうたい 行動 こうどう 条件 じょうけん 付 つ 独立 どくりつ 換 いか 決定 けってい 過程 かてい 状態 じょうたい 遷移 せんい マルコフ性 せい を満 み

マルコフ決定 けってい 過程 かてい マルコフ連鎖 れんさ に(選択 せんたく 可能 かのう 行動 こうどう 行動 こうどう 計画 けいかく 動機 どうき 与 あた 報酬 ほうしゅう 追加 ついか 拡張 かくちょう 解釈 かいしゃく 逆 ぎゃく 言 い 各 かく 行動 こうどう 状態 じょうたい 依存 いぞん 決定 けってい 過程 かてい 等価 とうか 連鎖 れんさ 置 お 換 か 出来 でき

有限 ゆうげん 決定 けってい 過程 かてい 要素 ようそ 組 くみ

⟨

S

,

A

,

T

,

R

⟩

{\textstyle {\big \langle }S,A,T,R{\big \rangle }}

表 あらわ 各 かく 要素 ようそ 次 じ 意味 いみ

S

=

{

s

1

,

s

2

,

…

,

s

N

}

{\displaystyle S=\{s^{1},s^{2},\ldots ,s^{N}\}}

状態 じょうたい 有限 ゆうげん 集合 しゅうごう

A

=

{

a

1

,

a

2

,

…

,

a

K

}

{\displaystyle A=\{a^{1},a^{2},\ldots ,a^{K}\}}

行動 こうどう 有限 ゆうげん 集合 しゅうごう

T

:

S

×

A

×

S

→

[

0

,

1

]

{\displaystyle T:S\times A\times S\to [0,1]}

遷移 せんい 関数 かんすう

R

:

S

×

A

×

S

→

R

{\displaystyle R:S\times A\times S\to \mathbb {R} }

報酬 ほうしゅう 関数 かんすう 遷移 せんい 関数 かんすう

T

(

s

,

a

,

s

′

)

{\displaystyle T(s,a,s')}

状態 じょうたい

s

{\displaystyle s}

行動 こうどう

a

{\displaystyle a}

取 と 状態 じょうたい

s

′

{\displaystyle s'}

状態 じょうたい 遷移 せんい 確 かく 率 りつ

T

(

s

,

a

,

s

′

)

=

Pr

(

s

t

+

1

=

s

′

|

s

t

=

s

,

a

t

=

a

)

{\displaystyle T(s,a,s')=\Pr(s_{t+1}=s'|s_{t}=s,a_{t}=a)}

報酬 ほうしゅう 関数 かんすう

R

(

s

,

a

,

s

′

)

{\displaystyle R(s,a,s')}

状態 じょうたい

s

{\displaystyle s}

s

′

{\displaystyle s'}

行動 こうどう

a

{\displaystyle a}

伴 ともな 遷移 せんい 際 さい 得 え 即時 そくじ 報酬 ほうしゅう 期待 きたい 値 ち

E

[

r

t

+

1

|

s

,

a

,

s

′

]

{\displaystyle \mathbb {E} [r_{t+1}|s,a,s']}

表 あらわ

MDP における基本 きほん 的 てき 問題 もんだい 設定 せってい 現在 げんざい 状態 じょうたい

s

{\displaystyle s}

与 あた 意思 いし 決定 けってい 者 しゃ 取 と 行動 こうどう

a

∈

A

{\displaystyle a\in A}

既定 きてい 方策 ほうさく 求 もと 方策 ほうさく 通常 つうじょう

s

,

a

{\displaystyle s,a}

条件 じょうけん 付 つ 分布 ぶんぷ

P

(

a

|

s

)

{\displaystyle P(a|s)}

規定 きてい 状態 じょうたい

s

{\displaystyle s}

行動 こうどう

a

{\displaystyle a}

取 と 確 かく 率 りつ

π ぱい (

s

,

a

)

{\displaystyle \pi (s,a)}

表記 ひょうき

方策 ほうさく 求 もと 際 さい 用 もち 目的 もくてき 関数 かんすう 典型 てんけい 的 てき 現在 げんざい 時刻 じこく 無限 むげん 区間 くかん 先 さき 未来 みらい 割引 わりびき 報酬 ほうしゅう 累積 るいせき 値 ち 用 もち

∑

t

=

0

∞

γ がんま

t

r

t

+

1

where

a

t

=

π ぱい (

s

t

)

{\displaystyle \sum _{t=0}^{\infty }\gamma ^{t}r_{t+1}\quad {\text{where}}\ a_{t}=\pi (s_{t})}

ここで

γ がんま ∈

[

0

,

1

]

{\displaystyle \gamma \in [0,1]}

割引 わりびき 率 りつ 呼 よ 値 ね 現在 げんざい 報酬 ほうしゅう 未来 みらい 報酬 ほうしゅう 間 あいだ 重要 じゅうよう 度 ど 差異 さい 表 あらわ 状態 じょうたい 確 かく 率 りつ 的 てき 遷移 せんい 上 うえ 値 ね 確 かく 率 りつ 変数 へんすう 通常 つうじょう 期待 きたい 値 ち 用 もち

MDP は線形 せんけい 計画 けいかく 法 ほう 動的 どうてき 計画 けいかく 法 ほう 解 と 後者 こうしゃ 示 しめ

いま,ある(定常 ていじょう 方策 ほうさく

π ぱい

{\displaystyle \pi }

採用 さいよう 場合 ばあい 割引 わりびき 報酬 ほうしゅう 和 わ

V

π ぱい

(

s

)

=

E

π ぱい

[

∑

t

=

0

∞

γ がんま

t

r

t

+

1

|

s

0

=

s

]

{\textstyle V^{\pi }(s)=\mathbb {E} _{\pi }[\sum _{t=0}^{\infty }\gamma ^{t}r_{t+1}\ |s_{0}=s]}

現在 げんざい 状態 じょうたい

s

{\displaystyle s}

依存 いぞん 状態 じょうたい 価値 かち 関数 かんすう 呼 よ

E

π ぱい

[

⋅

]

{\displaystyle \mathbb {E} _{\pi }[\cdot ]}

方策 ほうさく

π ぱい

{\displaystyle \pi }

下 した 条件 じょうけん 付 つ 期待 きたい 値 ち 状態 じょうたい 価値 かち 関数 かんすう

V

π ぱい

(

s

)

{\displaystyle V^{\pi }(s)}

次 つぎ 式 しき 満 み

V

π ぱい

(

s

)

=

∑

a

∈

A

π ぱい (

s

,

a

)

∑

s

′

∈

S

T

(

s

,

a

,

s

′

)

(

R

(

s

,

a

,

s

′

)

+

γ がんま

V

π ぱい

(

s

′

)

)

=

R

π ぱい

(

s

)

+

γ がんま

∑

a

∈

A

∑

s

′

∈

S

π ぱい (

s

,

a

)

T

(

s

,

a

,

s

′

)

V

π ぱい

(

s

′

)

{\displaystyle {\begin{aligned}V^{\pi }(s)&=\sum _{a\in A}\pi (s,a)\sum _{s'\in S}T(s,a,s'){\Big (}R(s,a,s')+\gamma V^{\pi }(s'){\Big )}\\&=R^{\pi }(s)+\gamma \sum _{a\in A}\sum _{s'\in S}\pi (s,a)T(s,a,s')V^{\pi }(s')\end{aligned}}}

R

π ぱい

(

s

)

=

∑

a

∈

A

∑

s

′

∈

S

π ぱい (

s

,

a

)

T

(

s

,

a

,

s

′

)

R

(

s

,

a

,

s

′

)

{\textstyle R^{\pi }(s)=\sum _{a\in A}\sum _{s'\in S}\pi (s,a)T(s,a,s')R(s,a,s')}

状態 じょうたい

s

{\displaystyle s}

方策 ほうさく

π ぱい

{\displaystyle \pi }

採用 さいよう 場合 ばあい 即時 そくじ 報酬 ほうしゅう 期待 きたい 値 ち

任意 にんい

π ぱい ′

{\displaystyle \pi '}

s

∈

S

{\displaystyle s\in S}

対 たい

V

π ぱい

∗

(

s

)

≥

V

π ぱい ′

(

s

)

{\displaystyle V^{\pi ^{*}}(s)\geq V^{\pi '}(s)}

満 み 方策 ほうさく

π ぱい

∗

{\displaystyle \pi ^{*}}

最適 さいてき 方策 ほうさく 呼 よ

π ぱい

∗

{\displaystyle \pi ^{*}}

採用 さいよう 状態 じょうたい 価値 かち 関数 かんすう 最大 さいだい 値 ち

V

∗

(

s

)

=

max

π ぱい

V

π ぱい

(

s

)

{\displaystyle V^{*}(s)=\max _{\pi }V^{\pi }(s)}

次 つぎ ベルマン方程式 ほうていしき を満 み

V

∗

(

s

)

=

max

a

∈

A

∑

s

′

∈

S

T

(

s

,

a

,

s

′

)

(

R

(

s

,

a

,

s

′

)

+

γ がんま

V

∗

(

s

′

)

)

{\displaystyle V^{*}(s)=\max _{a\in A}\sum _{s'\in S}T(s,a,s'){\Big (}R(s,a,s')+\gamma V^{*}(s'){\Big )}}

価値 かち 反復 はんぷく 法 ほう 後 うし 向 む 帰納 きのう 法 ほう 呼 よ 方程式 ほうていしき 満 み 価値 かち 関数 かんすう 繰 く 返 かえ 計算 けいさん 求 もと ロイド・シャープレー が1953年 ねん 発表 はっぴょう 確 かく 率 りつ (英語 えいご 版 ばん 関 かん 論文 ろんぶん 価値 かち 反復 はんぷく 法 ほう 特殊 とくしゅ 場合 ばあい 含 ふく 認知 にんち 後 のち

ステップ

i

{\displaystyle i}

価値 かち 関数 かんすう 計算 けいさん 結果 けっか

V

i

(

s

)

{\displaystyle V_{i}(s)}

表記 ひょうき 価値 かち 反復 はんぷく 法 ほう 更新 こうしん 式 しき 記述 きじゅつ

V

i

+

1

(

s

)

←

max

a

∈

A

s

∑

s

′

∈

S

T

(

s

,

a

,

s

′

)

(

R

(

s

,

a

,

s

′

)

+

γ がんま

V

i

(

s

′

)

)

∀

s

∈

S

{\displaystyle V_{i+1}(s)\leftarrow \max _{a\in A_{s}}\sum _{s'\in S}T(s,a,s'){\Big (}R(s,a,s')+\gamma V_{i}(s'){\Big )}\quad \forall s\in S}

上 うえ 式 しき 状態 じょうたい 値 ね 収束 しゅうそく 繰 く 返 かえ 値 ね

V

∞

(

s

)

{\displaystyle V^{\infty }(s)}

最適 さいてき 方策 ほうさく

π ぱい

∗

{\displaystyle \pi ^{*}}

次 つぎ 式 しき 求 もと

π ぱい

∗

(

s

)

←

arg

max

a

∈

A

s

∑

s

′

∈

S

T

(

s

,

a

,

s

′

)

(

R

(

s

,

a

,

s

′

)

+

γ がんま

V

∞

(

s

′

)

)

∀

s

∈

S

{\displaystyle \pi ^{*}(s)\leftarrow \arg \max _{a\in A_{s}}\sum _{s'\in S}T(s,a,s'){\Big (}R(s,a,s')+\gamma V^{\infty }(s'){\Big )}\quad \forall s\in S}

方策 ほうさく 反復 はんぷく 法 ほう 方策 ほうさく 固定 こてい 下 した 行 おこな 価値 かち 関数 かんすう 更新 こうしん 価値 かち 関数 かんすう 固定 こてい 行 おこな 方策 ほうさく 更新 こうしん 交互 こうご 行 おこな 最適 さいてき 方策 ほうさく 求 もと

次 つぎ 線形 せんけい 方程式 ほうていしき 解 と 価値 かち 関数 かんすう 更新 こうしん

V

π ぱい

(

s

)

=

R

π ぱい

(

s

)

+

γ がんま

∑

a

∈

A

∑

s

′

∈

S

π ぱい (

s

,

a

)

T

(

s

,

a

,

s

′

)

V

π ぱい

(

s

′

)

{\displaystyle V^{\pi }(s)=R^{\pi }(s)+\gamma \sum _{a\in A}\sum _{s'\in S}\pi (s,a)T(s,a,s')V^{\pi }(s')}

方策 ほうさく 次 つぎ 式 しき 更新 こうしん

π ぱい (

s

)

←

arg

max

a

∈

A

s

∑

s

′

∈

S

T

(

s

,

a

,

s

′

)

(

R

(

s

,

a

,

s

′

)

+

γ がんま

V

π ぱい

(

s

′

)

)

∀

s

∈

S

{\displaystyle \pi (s)\leftarrow \arg \max _{a\in A_{s}}\sum _{s'\in S}T(s,a,s'){\Big (}R(s,a,s')+\gamma V^{\pi }(s'){\Big )}\quad \forall s\in S}

これらの操作 そうさ

π ぱい

{\displaystyle \pi }

状態 じょうたい 対 たい 変化 へんか 繰 く 返 かえ 最適 さいてき 方策 ほうさく 得 え 方策 ほうさく 反復 はんぷく 法 ほう 離散 りさん 値 ち 取 と 方策 ほうさく 値 ね 変化 へんか 明確 めいかく 終了 しゅうりょう 条件 じょうけん 持 も 有限 ゆうげん 時間 じかん 終了 しゅうりょう 利点 りてん 持 も

部分 ぶぶん 観測 かんそく 決定 けってい 過程 かてい [ 編集 へんしゅう ] MDP では方策 ほうさく

π ぱい (

s

)

{\displaystyle \pi (s)}

計算 けいさん 際 さい 現在 げんざい 状態 じょうたい

s

{\displaystyle s}

既知 きち 仮定 かてい 実際 じっさい 状態 じょうたい 観測 かんそく 不 ふ 確実 かくじつ 性 せい 伴 ともな 場合 ばあい 仮定 かてい 成 な 場合 ばあい 多 おお 場合 ばあい 一般 いっぱん 化 か 部分 ぶぶん 観測 かんそく 決定 けってい 過程 かてい 用 もち

状態 じょうたい 遷移 せんい 確 かく 率 りつ

T

(

s

,

a

,

s

′

)

{\displaystyle T(s,a,s')}

報酬 ほうしゅう 関数 かんすう

R

(

s

,

a

,

s

′

)

{\displaystyle R(s,a,s')}

未知 みち 場合 ばあい 環境 かんきょう 相互 そうご 作用 さよう 通 つう 情報 じょうほう 得 え 行動 こうどう 決定 けってい 必要 ひつよう 生 しょう 問題 もんだい 強化 きょうか 学習 がくしゅう 枠組 わくぐ 議論 ぎろん

強化 きょうか 学習 がくしゅう 代表 だいひょう 的 てき 学習 がくしゅう Q学習 がくしゅう と呼 よ 学習 がくしゅう 行動 こうどう 価値 かち 関数 かんすう 呼 よ 関数 かんすう

Q

π ぱい

(

s

,

a

)

{\displaystyle Q^{\pi }(s,a)}

着目 ちゃくもく

Q

π ぱい

(

s

,

a

)

{\displaystyle Q^{\pi }(s,a)}

次 つぎ 定義 ていぎ

Q

π ぱい

(

s

,

a

)

=

E

π ぱい

[

∑

t

=

0

∞

γ がんま

t

r

t

+

1

|

s

0

=

s

,

a

0

=

a

]

{\displaystyle Q^{\pi }(s,a)=\mathbb {E} _{\pi }[\sum _{t=0}^{\infty }\gamma ^{t}r_{t+1}|s_{0}=s,a_{0}=a]}

いま,最適 さいてき 方策 ほうさく 行動 こうどう 価値 かち 関数 かんすう

Q

∗

(

s

,

a

)

=

max

π ぱい

Q

π ぱい

(

s

,

a

)

{\displaystyle Q^{*}(s,a)=\max _{\pi }Q^{\pi }(s,a)}

V

∗

(

s

)

=

max

a

Q

∗

(

s

,

a

)

{\displaystyle V^{*}(s)=\max _{a}Q^{*}(s,a)}

満 み

Q

∗

{\displaystyle Q^{*}}

学習 がくしゅう 直接 ちょくせつ 求 もと 最適 さいてき 方策 ほうさく 獲得 かくとく 学習 がくしゅう 各 かく 試行 しこう 遷移 せんい 前後 ぜんこう 状態 じょうたい 入力 にゅうりょく 試行 しこう 得 え 即時 そくじ 報酬 ほうしゅう 実現 じつげん 値 ち

Q

(

s

,

a

)

{\displaystyle Q(s,a)}

値 ね 逐次 ちくじ 更新 こうしん 実際 じっさい 学習 がくしゅう 状態 じょうたい 十分 じゅうぶん 確 かく 率 りつ 的 てき 含 ふく 学習 がくしゅう 時 じ 行動 こうどう 選択 せんたく

強化 きょうか 学習 がくしゅう 最適 さいてき 化 か 必要 ひつよう 学習 がくしゅう 状態 じょうたい 遷移 せんい 確 かく 率 りつ 報酬 ほうしゅう 関数 かんすう 介 かい 出来 でき 価値 かち 反復 はんぷく 法 ほう 方策 ほうさく 反復 はんぷく 法 ほう 明示 めいじ 的 てき 仕様 しよう 各 かく 状態 じょうたい 間 あいだ 遷移 せんい 可能 かのう 性 せい 報酬 ほうしゅう 関数 かんすう 関数 かんすう 形 がた 与 あた 必要 ひつよう 状態 じょうたい 数 すう 行動 こうどう 選択肢 せんたくし 膨大 ぼうだい 場合 ばあい 強化 きょうか 学習 がくしゅう 関数 かんすう 近似 きんじ 組 く 合 あ

機械 きかい 学習 がくしゅう 理論 りろん 一 ひと 応用 おうよう 学習 がくしゅう 呼 よ 環境 かんきょう 確 かく 率 りつ 的 てき 挙動 きょどう 示 しめ 場合 ばあい 強化 きょうか 学習 がくしゅう 一 ひと 学習 がくしゅう 関 かん 最初 さいしょ 詳細 しょうさい 論文 ろんぶん 年 ねん 有限 ゆうげん 状態 じょうたい 明示 めいじ 的 てき 記載 きさい 強化 きょうか 学習 がくしゅう 同様 どうよう 学習 がくしゅう 確 かく 率 りつ 報酬 ほうしゅう 未知 みち 場合 ばあい 問題 もんだい 解 と 学習 がくしゅう 違 ちが 価値 かち 関数 かんすう 学習 がくしゅう 結果 けっか 探 さが 行動 こうどう 確 かく 率 りつ 直接 ちょくせつ 求 もと 学習 がくしゅう 収束 しゅうそく 性 せい 解析 かいせき 学 がく 要領 ようりょう 厳密 げんみつ 証明 しょうめい

制約 せいやく 付 つ 決定 けってい 過程 かてい 決定 けってい 過程 かてい 拡張 かくちょう 基本 きほん 的 てき 違 ちが

ある行動 こうどう 代 か 適用 てきよう 後 のち 複数 ふくすう 発生 はっせい

CMDP は線形 せんけい 計画 けいかく 法 ほう 解 と 出来 でき 動的 どうてき 計画 けいかく 法 ほう 用 もち

終端 しゅうたん 時刻 じこく 方策 ほうさく 初期 しょき 状態 じょうたい 依存 いぞん CMDP の応 おう 用例 ようれい 数多 かずおお 存在 そんざい 最近 さいきん 工学 こうがく 用 もち

Bellman, R. (1957). “A Markovian Decision Process” . Journal of Mathematics and Mechanics 6 . http://www.iumj.indiana.edu/IUMJ/FULLTEXT/1957/6/56038 . Howard, Ronald. A. (1960). Dynamic Programming and Markov Processes . The M.I.T. Press Shapley, Lloyd. (1953). “Stochastic Games”. Proceedings of National Academy of Science 39 : 1095–1100. Kallenberg, Lodewijk. (2002). “Finite state and action MDPs”. Handbook of Markov decision processes: methods and applications . Springer. ISBN 0-7923-7459-2 Sutton, R. S.; Barto, A. G. (1998). Reinforcement Learning: An Introduction . http://webdocs.cs.ualberta.ca/~sutton/book/the-book.html Narendra, K. S.; Thathachar, M. A. L. (1974). “Learning Automata - A Survey” . IEEE Transactions on Systems, Man, and Cybernetics SMC-4 (4): 323–334. doi :10.1109/TSMC.1974.5408453 . ISSN 0018-9472 . http://ieeexplore.ieee.org/stamp/stamp.jsp?arnumber=5408453 . Narendra, Kumpati S.; Thathachar, Mandayam A. L. (1989). Learning automata: An introduction ISBN 9780134855585 . https://books.google.com/books?id=hHVQAAAAMAAJ Altman, Eitan (1999). Constrained Markov decision processes . 7 . CRC Press Feyzabadi, S.; Carpin, S. (2014). "Risk-aware path planning using hierarchical constrained Markov Decision Processes" . Automation Science and Engineering (CASE) . IEEE International Conference. pp. 297, 303. doi :10.1109/CoASE.2014.6899341 。 木村 きむら 元 もと “《第 だい 回 かい 強化 きょうか 学習 がくしゅう 基礎 きそ . 計測 けいそく 制御 せいぎょ 計測 けいそく 自動 じどう 制御 せいぎょ 学会 がっかい 52 (1): 72-77. NAID 10031140795 . https://doi.org/10.11499/sicejl.52.72 .

![{\displaystyle T:S\times A\times S\to [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/69a2a983071005aecfd5a367d16d492044308fe1)

![{\displaystyle \mathbb {E} [r_{t+1}|s,a,s']}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a52f9346fe5e76c4e71d42662a66b4e20cd87545)

![{\displaystyle \gamma \in [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cbc65bc4fa0e25a8305259b234865def64ac1a8a)

![{\textstyle V^{\pi }(s)=\mathbb {E} _{\pi }[\sum _{t=0}^{\infty }\gamma ^{t}r_{t+1}\ |s_{0}=s]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dcc93e242695f56171870c541b18592604751af3)

![{\displaystyle \mathbb {E} _{\pi }[\cdot ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6af14353fe2ec61ef0125ed7b305b09ce721f9d0)

![{\displaystyle Q^{\pi }(s,a)=\mathbb {E} _{\pi }[\sum _{t=0}^{\infty }\gamma ^{t}r_{t+1}|s_{0}=s,a_{0}=a]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/943a0121f9da52c6bf3e97edd724ec7cd534b178)